Processos Pontuais

Aula 07: Teoria e Prática em R

Instituto de Matemática, Estatística e Ciência da Computação (IME‑USP)

02/02/2026

Definição e Conceitos Fundamentais

O que são Processos Pontuais?

\(\Longrightarrow\) Dados que fornecem localizações espaciais de eventos (Diggle, 2013).

Modelos estocásticos que descrevem a disposição de eventos distribuídos irregular ou aleatoriamente no plano (\(B \subset \mathbb{R}^2\)) ou no espaço (Illian et al., 2008).

É uma coleção de variáveis aleatórias \(\{n(S): S \subseteq B\}\), onde \(n(S)\) é o número de eventos no subconjunto \(S\).

Tenho dados da forma \(Y_i \in \{1, 4, 5, 10, 200, 30, 60, \text{etc}.\}\)? Resp: Não necessariamente. A coordenada geográfica \((x,y)\) é a própria informação, não apenas um índice fixo \(Y_i \in \{1, 4, 5, 10, 200, 30, 60, \text{etc}.\}\). Suas coordenadas \((x,y)\) assumem o papel que \(Y\) assumia.

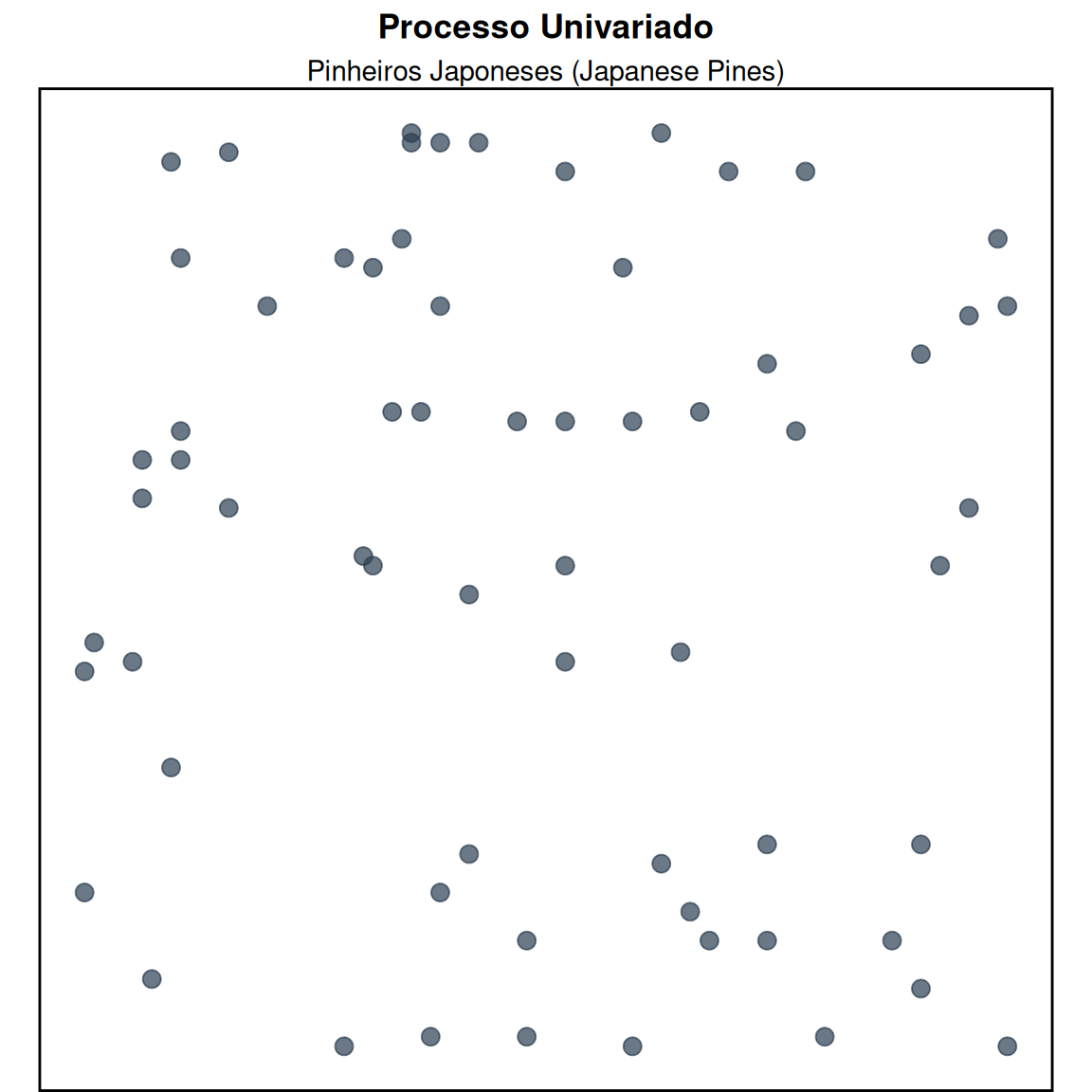

Exemplos de processos pontuais: Localização geográfica de árvores em uma floresta, epicentros de terremotos, casos de doenças, localizações de crimes.

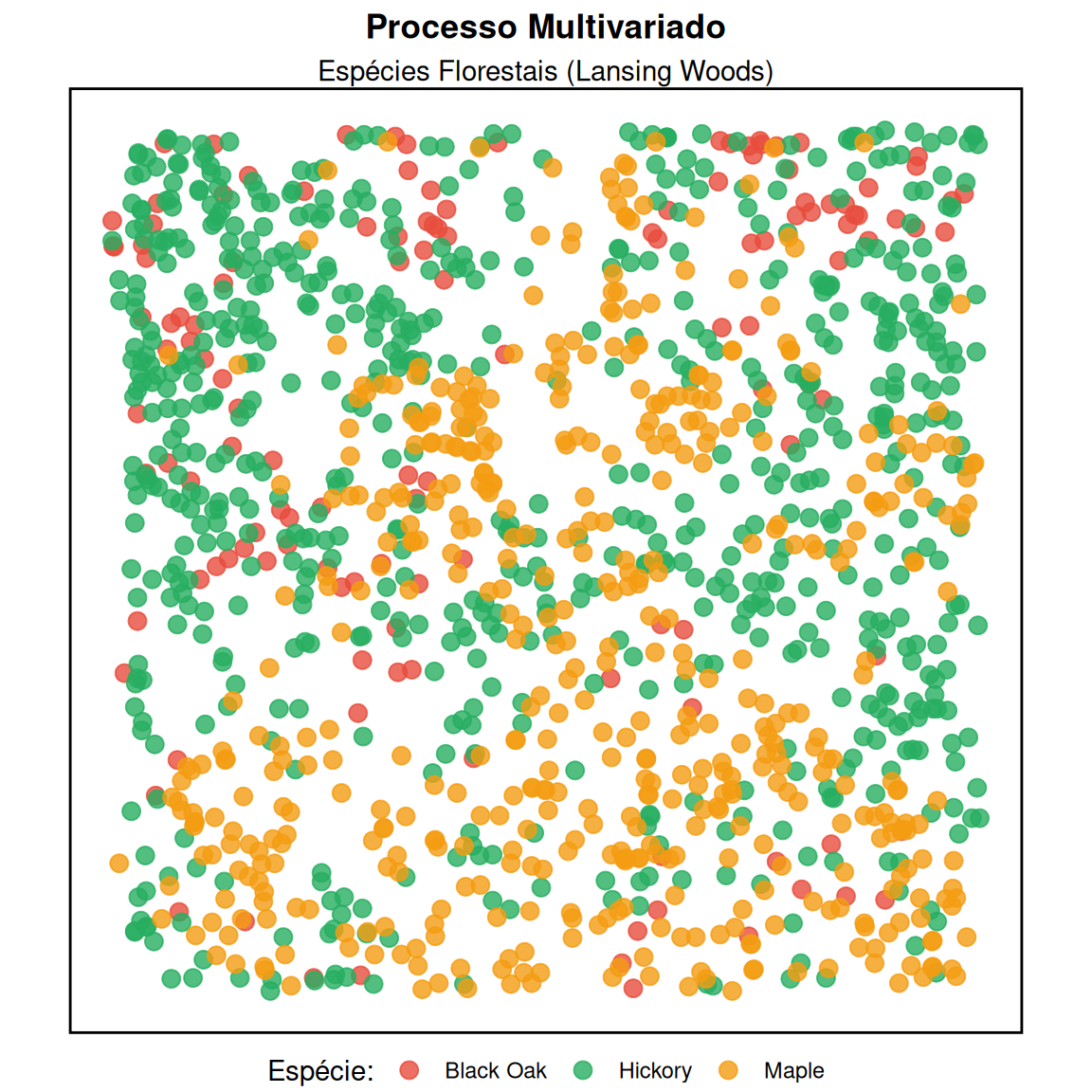

Classificação:

Univariado: Um único tipo de evento.

Multivariado: Múltiplos tipos (ex: árvores doentes vs. sadias) com foco na dependência interespecífica.

Elementos de Processos Pontuais

O que compõe um Processo Pontual?

Além das coordenadas geográficas puras, os processos pontuais frequentemente carregam informações adicionais e contextos ambientais.

Marcas: Informações intrínsecas ao evento.

Covariáveis: Informações do ambiente (contexto).

Marcas (Marks)

Um processo pontual pode envolver informações qualitativas ou quantitativas adicionais associadas a cada evento \(s_{i}=(x, y)\).

Essas informações adicionais são denominadas marcas, representadas por \(m(s_{i})\).

Seja \(B \subseteq \mathbb{R}^{d}\) a região de ocorrência e \(C \subseteq \mathbb{R}\) o espaço das marcas. Um processo pontual marcado \(M(B \times C)\) é representado por:

\[ M(B \times C) = \{[s_{i}, m(s_{i})]\}= \{[s_{1}, m(s_{1})], \ldots, [s_{n}, m(s_{n})]\}, \]

Onde \(s_{i} \in B\) e \(m(s_{i}) \in C\).

A natureza da marca depende do fenômeno estudado:

Florestas

Evento: Localização de árvores.

Marcas:

Altura das árvores.

Espécie florestal.

Diâmetro à altura do peito (DAP).

Trânsito

Evento: Acidentes em uma cidade.

Marcas:

Gravidade do acidente.

Ferimentos leves.

Fatalidades.

Comércio

Evento: Estabelecimentos comerciais.

Marcas:

Tipo de estabelecimento.

Restaurante.

Supermercado.

Covariáveis

Variáveis explicativas que auxiliam na compreensão da distribuição espacial dos eventos.

Covariáveis como quaisquer dados tratados como explicativos e não como resposta.

Diferença: A marca pertence ao ponto; a covariável pertence ao local (campo espacial).

Exemplos

Florestal: Função \(z(s_{i})\) descrevendo a altitude ou tipo de solo.

Criminologia: Densidade populacional, níveis de desemprego, acesso a serviços policiais.

Propriedades Fundamentais

Estacionaridade

Um processo é estacionário se a distribuição espacial dos eventos é invariante sob translação.

Seja \(N=\{s_{1}, \ldots , s_{n}\}\) um processo e \(N_{t} = \{s_{1} + t, \ldots , s_{n} +t\}\) sua translação.

\[ \forall t \in \mathbb{R}^{d}, N \stackrel{D}{=} N_{t} \]

Para Processos Marcados

A invariância se aplica ao par localização-marca:

\[ N_{[s_{i}, m(s_{i})]} \stackrel{D}{=} N_{\{[s_{i}+t, m(s_{i})]\}} \]

Isotropia

Um processo é isotrópico se a distribuição espacial é invariante sob rotação em torno da origem.

Seja \(R_{\alpha} N\) a rotação do processo por um ângulo \(\alpha\).

\[ \forall \alpha \in [0^{o}, 360^{o}], N \stackrel{D}{=} R_{\alpha} N \]

Para Processos Marcados

\[ N_{[s_{i}, m(s_{i})]} \stackrel{D}{=} R_{\alpha}N_{\{[s_{i}, m(s_{i})]\}} \]

Dica

Um processo pontual pode ser isotrópico sem ser estacionário (ex: densidade diminui radialmente do centro), mas o contrário não é verdadeiro em contextos geográficos usuais (Baddeley; Rubak; Turner, 2015).

Homogeneidade vs. Tendência Espacial

A propriedade de homogeneidade define a probabilidade de ocorrência no espaço.

Eventos ocorrem em proporções iguais em toda a área.

Probabilidade constante em qualquer sub-região.

\(\lambda(s) = \lambda\) (constante).

A probabilidade não é constante.

Certas áreas são mais propensas a eventos que outras.

Ocorre concentração em sub-regiões específicas.

Independência

Baseado na teoria da probabilidade: \(P(S\cap Z) = P(S)P(Z)\).

Em Processos Pontuais

Dois ou mais eventos são considerados independentes se a ocorrência de um evento em um local \(s_i\) não influencia a ocorrência de outros eventos em \(s_j\).

- Não há atração (agrupamento/cluster) nem repulsão (inibição/regularidade) entre os pontos.

Principais Distribuições de Probabilidade

Distribuição Uniforme

Seja \(B\) a região de estudo e \(|B|\) a sua área (ou volume).

Diz-se que os eventos estão uniformemente distribuídos se a probabilidade de ocorrência é constante dentro de \(B\) e nula fora.

\[ f(s_{i}) = \left\{\begin{array}{rcl} \frac{1}{|B|} & \text {se} & (x,y) \in B \\ 0 & \text{ se } & (x,y) \notin B . \end{array}\right. \]

Qual a probabilidade de um evento cair em uma sub-região \(S \subseteq B\)?

\[ P(s \in S) = \int_{S} f(x,y) dx dy = \frac{1}{|B|} \int_{S} 1 dx dy = \frac{|S|}{|B|} \]

Nota

A probabilidade depende apenas da proporção da área ocupada por \(S\) em relação a \(B\).

Distribuição Binomial

Temos um número fixo de eventos \(n\) na região \(B\).

Cada evento é um ensaio independente com probabilidade de sucesso \(p = \frac{|S|}{|B|}\).

\[ P(N(S)=\kappa) = \binom{n}{\kappa} p^{\kappa} (1-p)^{n-\kappa}; \quad \kappa= 0,1, \ldots, n \]

Valor Esperado e Intensidade

Sabe-se que \(\mathbb{E}(X) = n \cdot p\). Substituindo \(p\):

\[ \mu = \mathbb{E}[n(S\cap B)] = n \cdot \frac{|S|}{|B|} \quad \Longrightarrow \quad \hat{\lambda} (s) =\frac{n}{|B|} \]

\(\hat{\lambda}(s)\) é o estimador da intensidade sob homogeneidade.

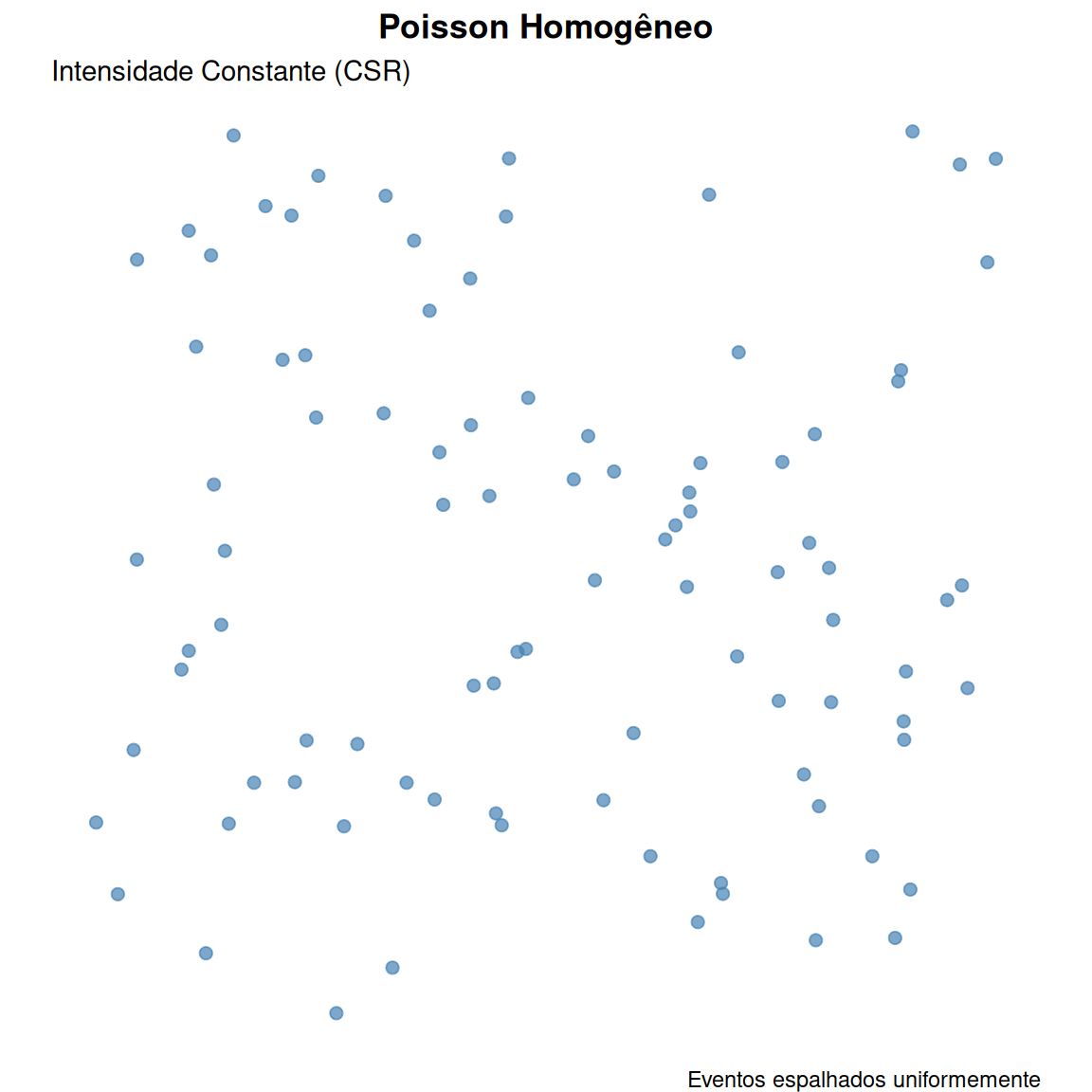

Distribuição Poisson

A distribuição para eventos raros e independentes.

\[ P(n(S)=k) = \frac{\mu^{k} e^{- \mu }}{k!} = \frac{\left(\lambda (s)|S| \right)^{k} e^{ - \lambda (s)|S|} }{k!} \]

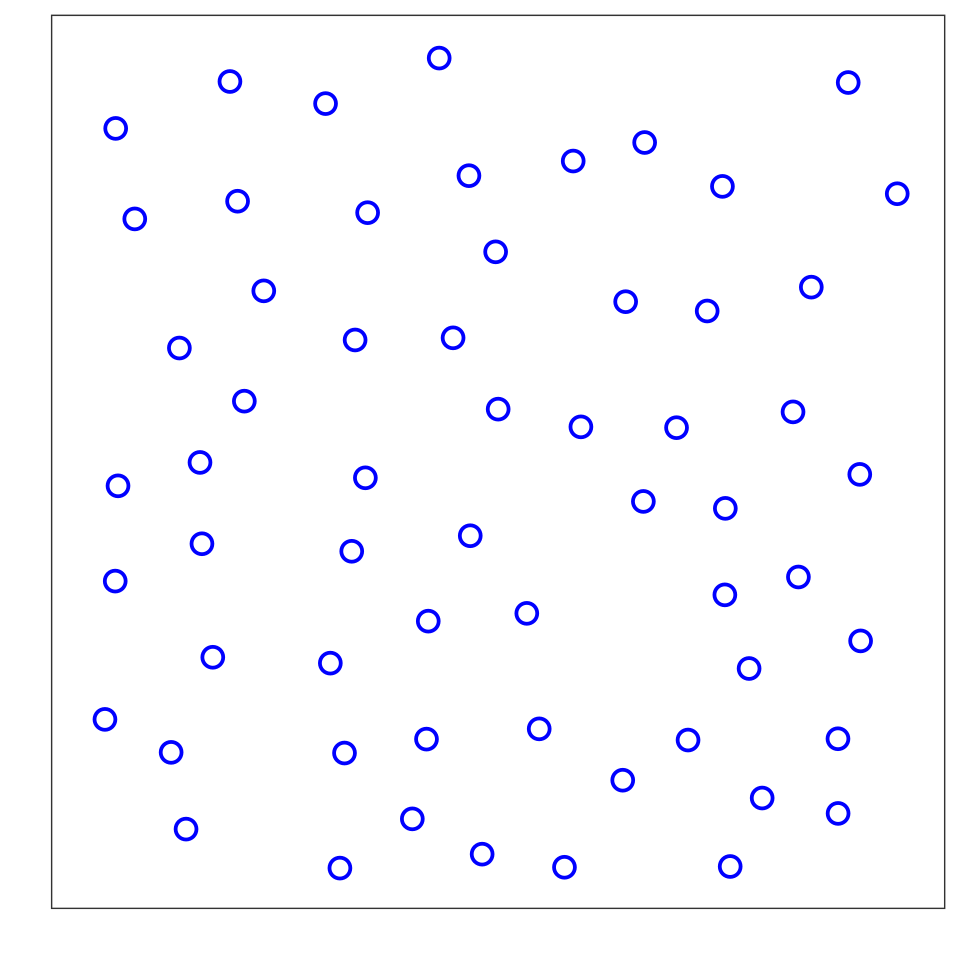

Características: Estacionário e Isotrópico.

CSR: Aleatoriedade Espacial Completa (Complete Spatial Randomness).

Intensidade: Constante em toda a região. \[ \forall s_{i}, s_{j} \in B: \lambda (s_{i}) \equiv \lambda (s_{j}) = \lambda \]

Média e Variância são iguais.

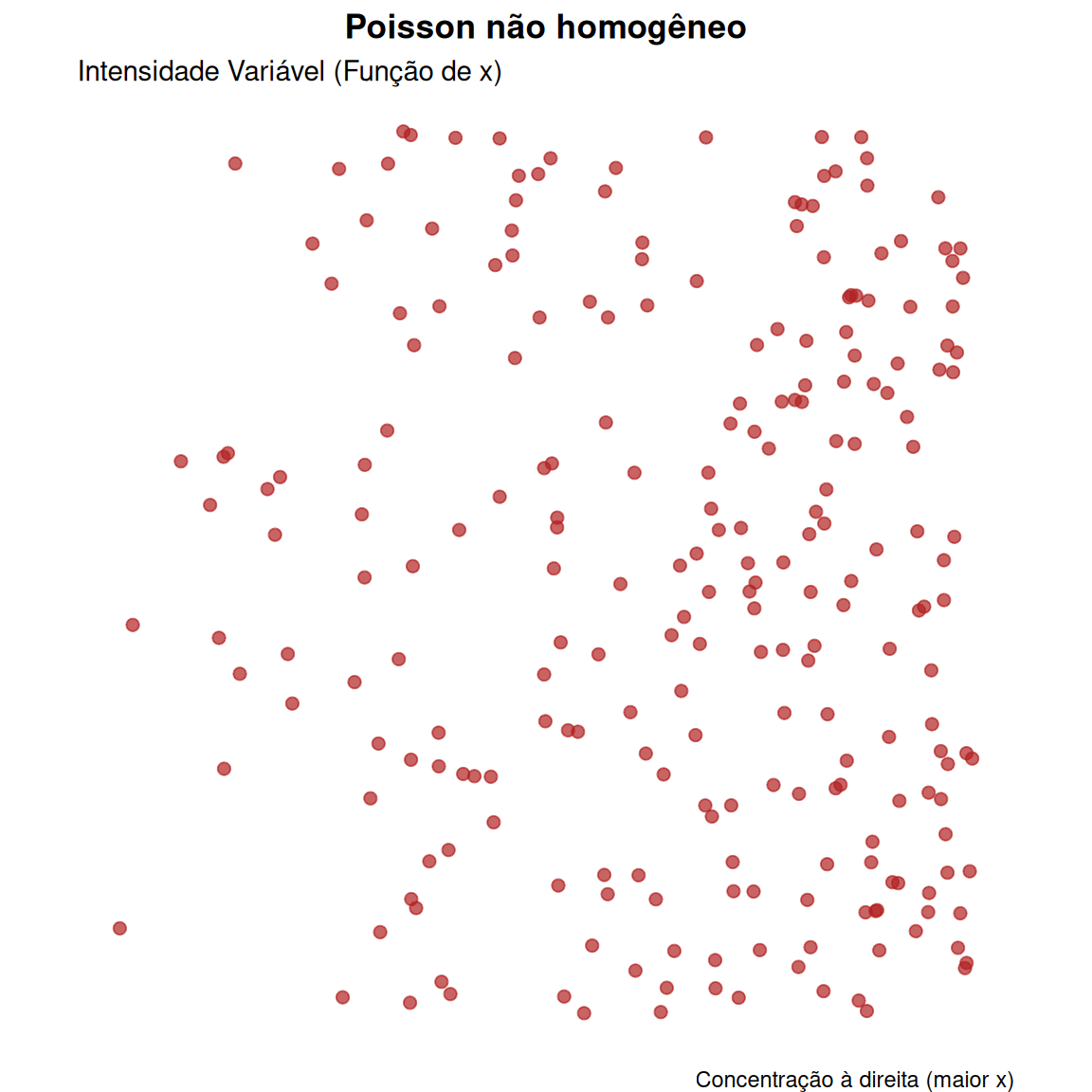

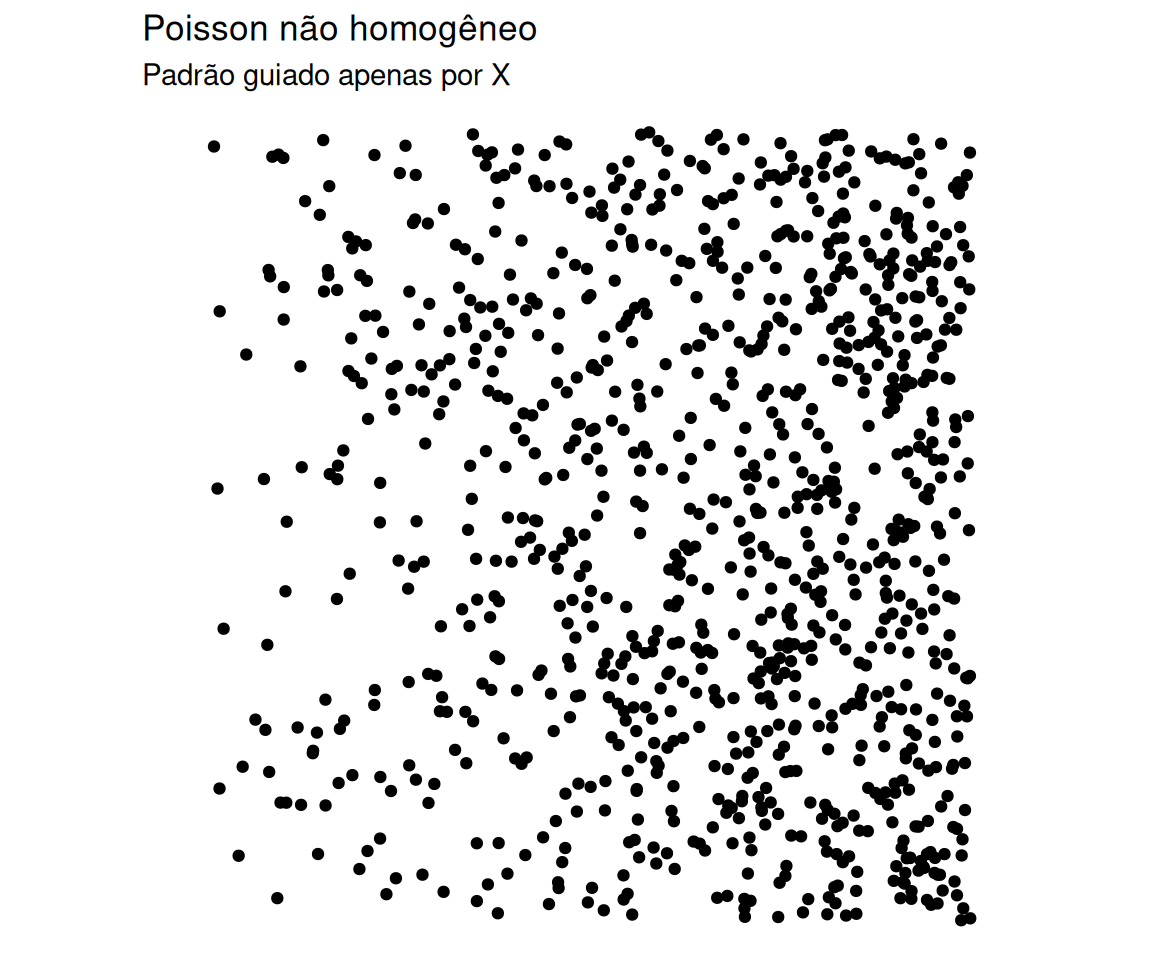

Características: Não estacionário.

Intensidade: Varia no espaço (função da localização).

\[ \exists \, s_{i} \in B: \lambda (s_{i}) \neq \lambda (s_{j}) \]

- O número médio de eventos é a integral da intensidade:

\[ \mu = \int_{B} \lambda (s) ds \]

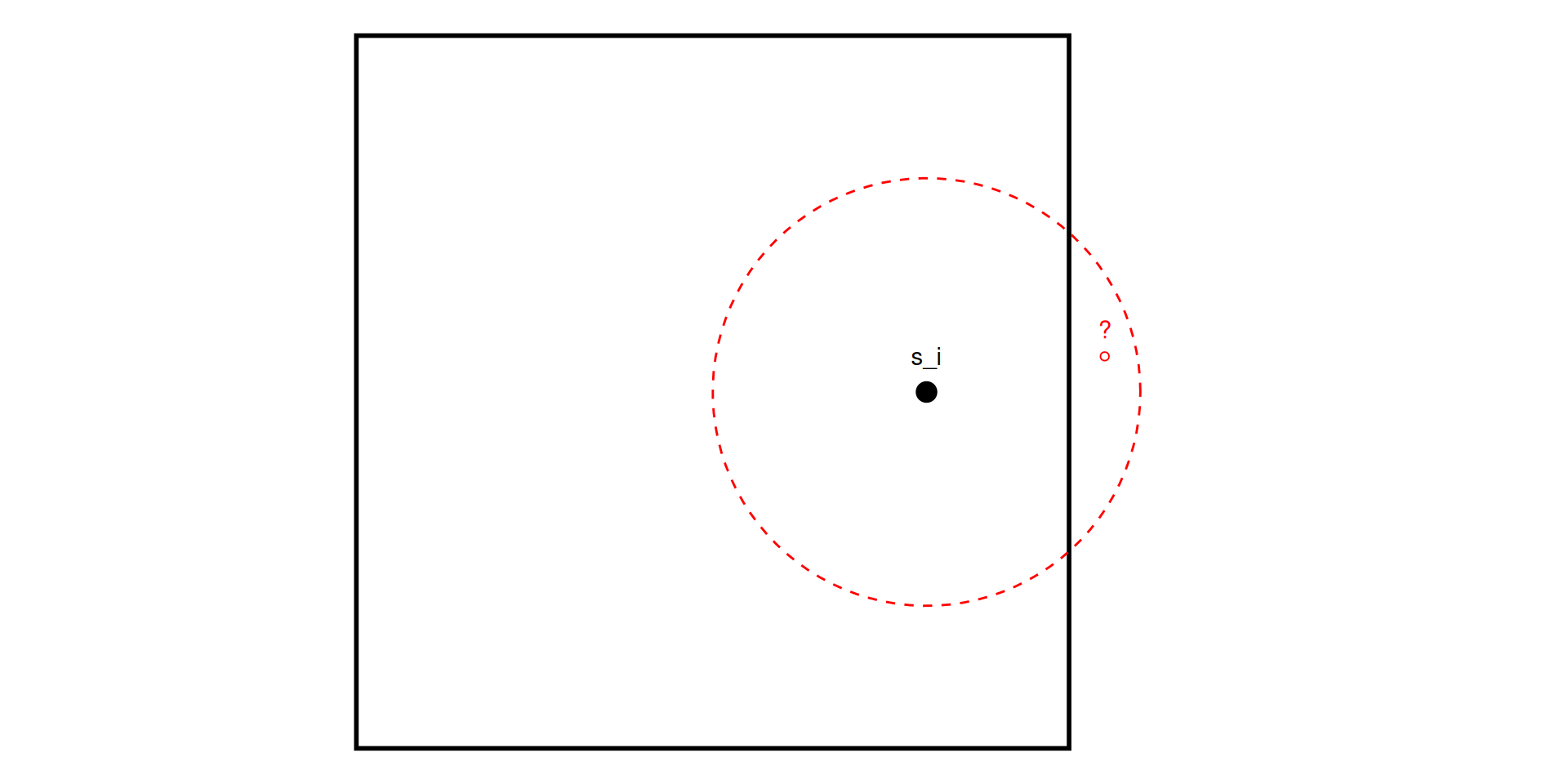

Propriedades de Primeira Ordem: Intensidade

Intensidade (\(\lambda\))

Seja \(S_i\) uma sub-região de \(B\) contendo \(n(s_i)\) eventos e com área \(|S_i|\).

A propriedade de primeira ordem, ou intensidade \(\lambda(s_i)\), corresponde ao número esperado de eventos por unidade de área:

\[ \lambda (s_{i}) = \lim_{|S_{i}| \to 0} \left\{\frac{ \mathbb{E}[n(s_{i})]}{|S_{i}|}\right\} \]

Se o processo for homogêneo, a intensidade é constante:

\[ \lambda (s_{i}) = \lambda \quad \Longrightarrow \quad \hat{\lambda}= \frac{n(B)}{|B|} \]

Métodos de Estimação da Intensidade

Como estimar \(\lambda(s)\) quando ela varia no espaço?

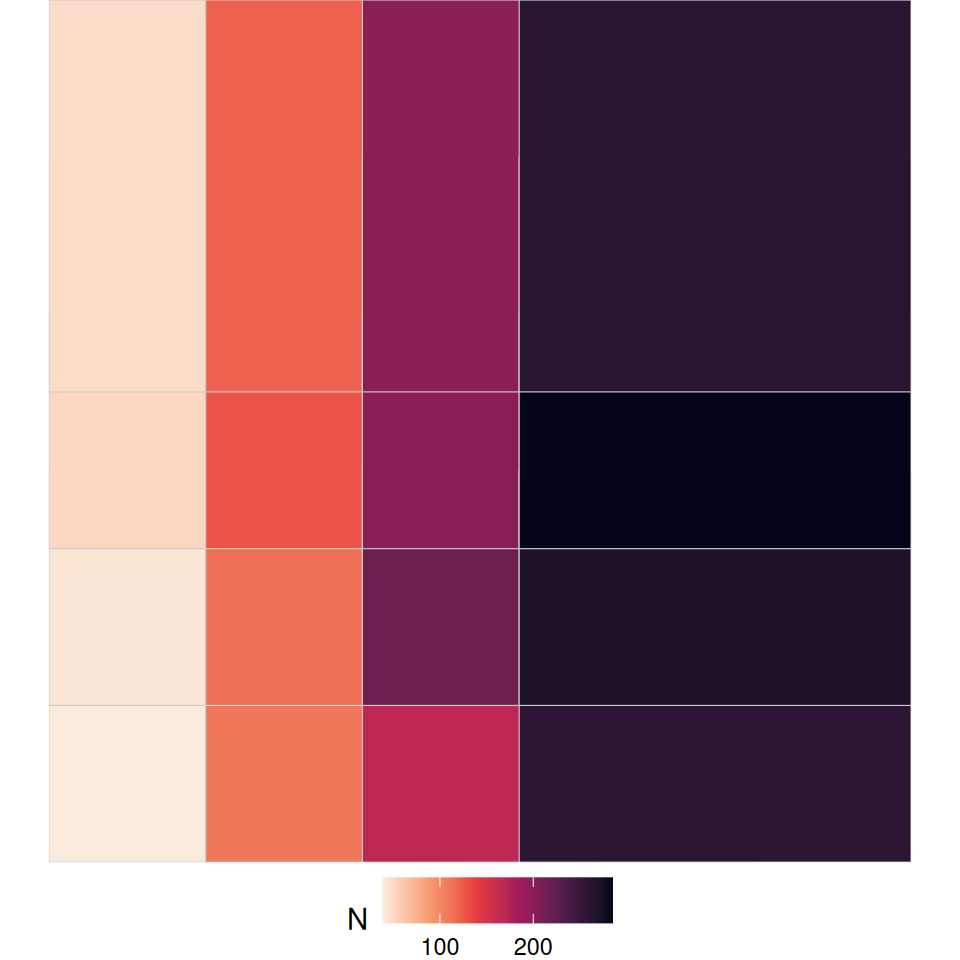

Divide a área em células regulares (

quadrats).Calcula a densidade bruta em cada célula: \(\hat{\lambda}_j = n_j / \text{Area}_j\).

Problema: Resulta em uma superfície descontínua.

Define uma janela (ex: disco) de tamanho fixo.

Move a janela pela região, contando eventos.

Problema: A escolha do tamanho da janela é arbitrária e ignora a distância relativa entre eventos dentro da janela (Gatrell et al., 1996).

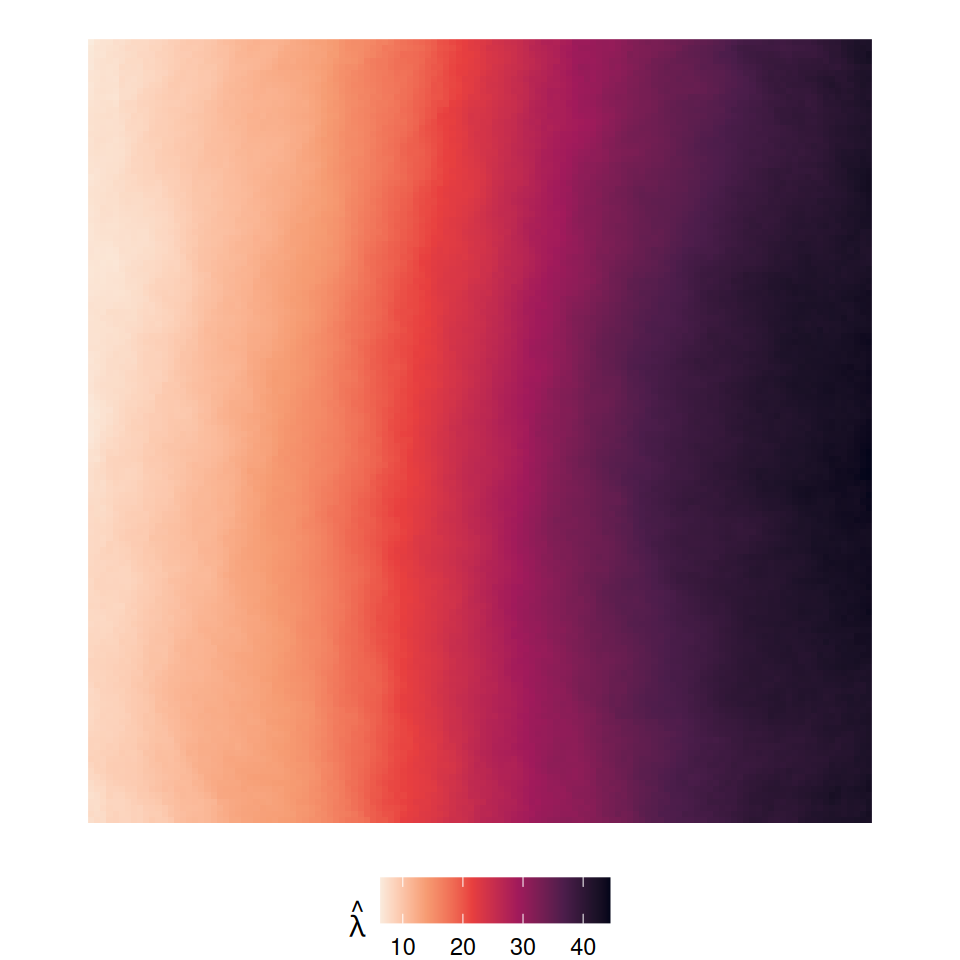

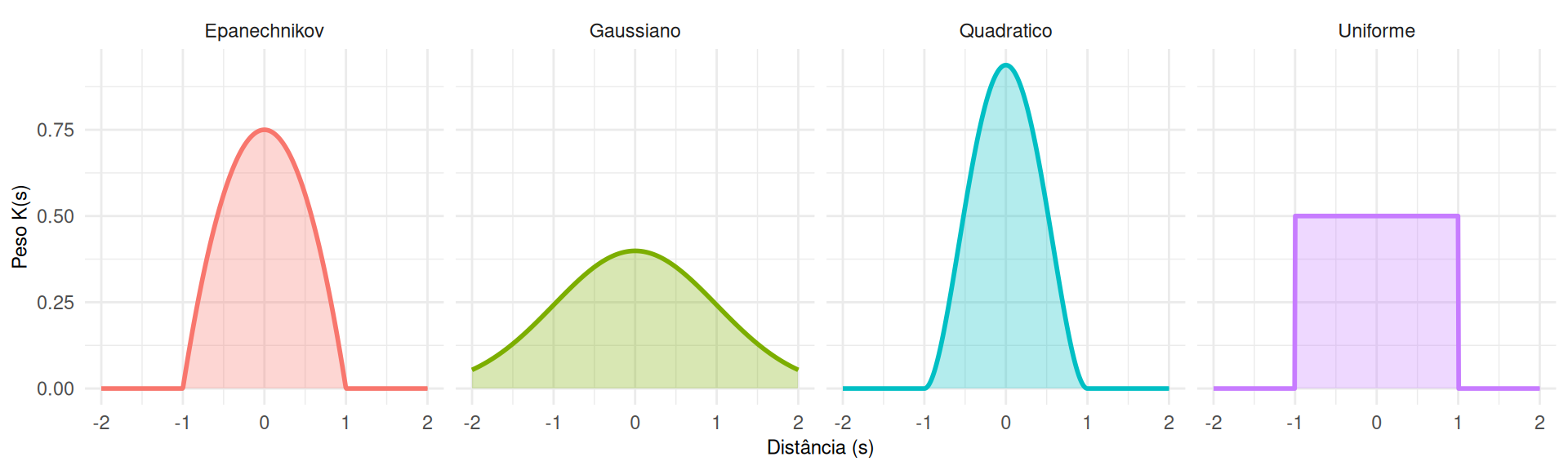

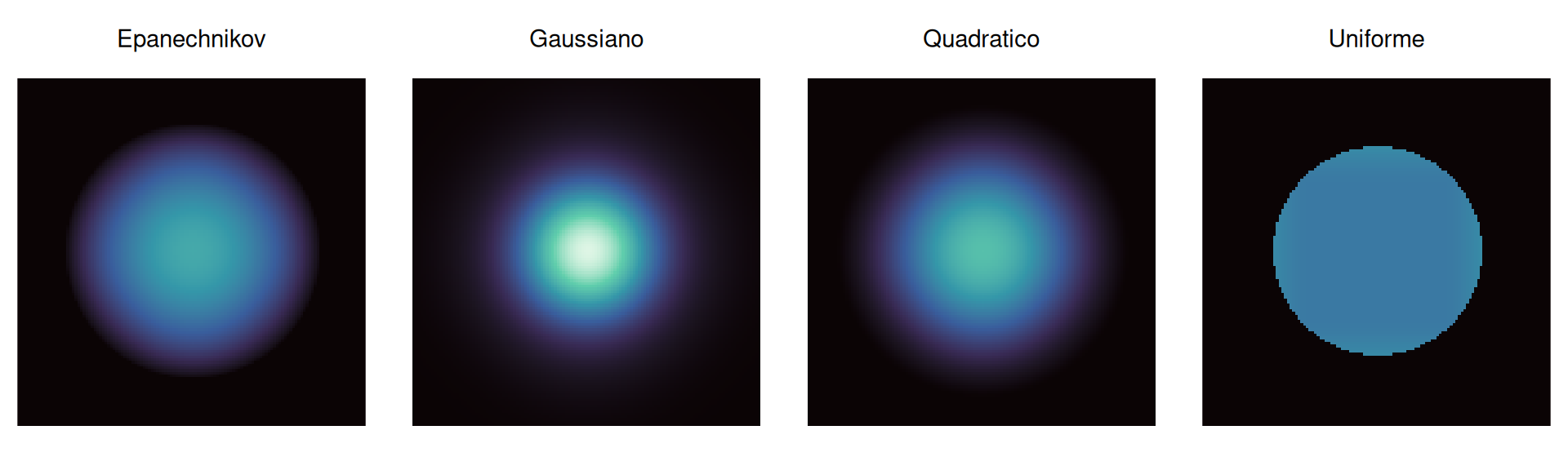

Substitui a janela fixa por uma função de ponderação suave (Kernel).

Pondera os eventos pela distância ao ponto de estimação \(z\).

\[\hat{\lambda}(z)=\sum_{i=1}^{n} \frac{1}{h^{2}}K\left(\frac{z-s_{i}}{h}\right)\]

\(K(\cdot)\): Função Kernel (perfil de ponderação).

\(h\): Largura de banda (suavização).

A Escolha do Kernel e da Largura de Banda (\(h\))

A escolha de \(h\) (bandwidth) é crítica:

\(h\) grande: Muita suavização (perde detalhes locais, aumenta viés).

\(h\) pequeno: Pouca suavização (muito ruído, aumenta variância).

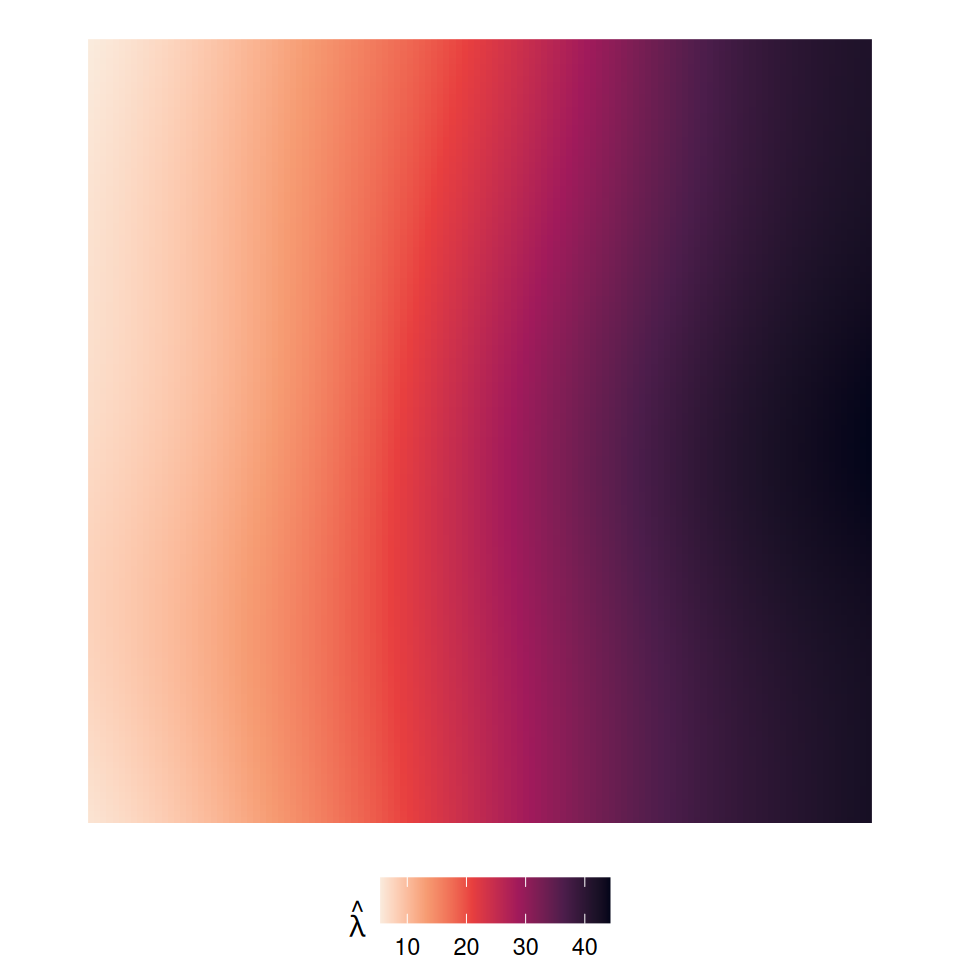

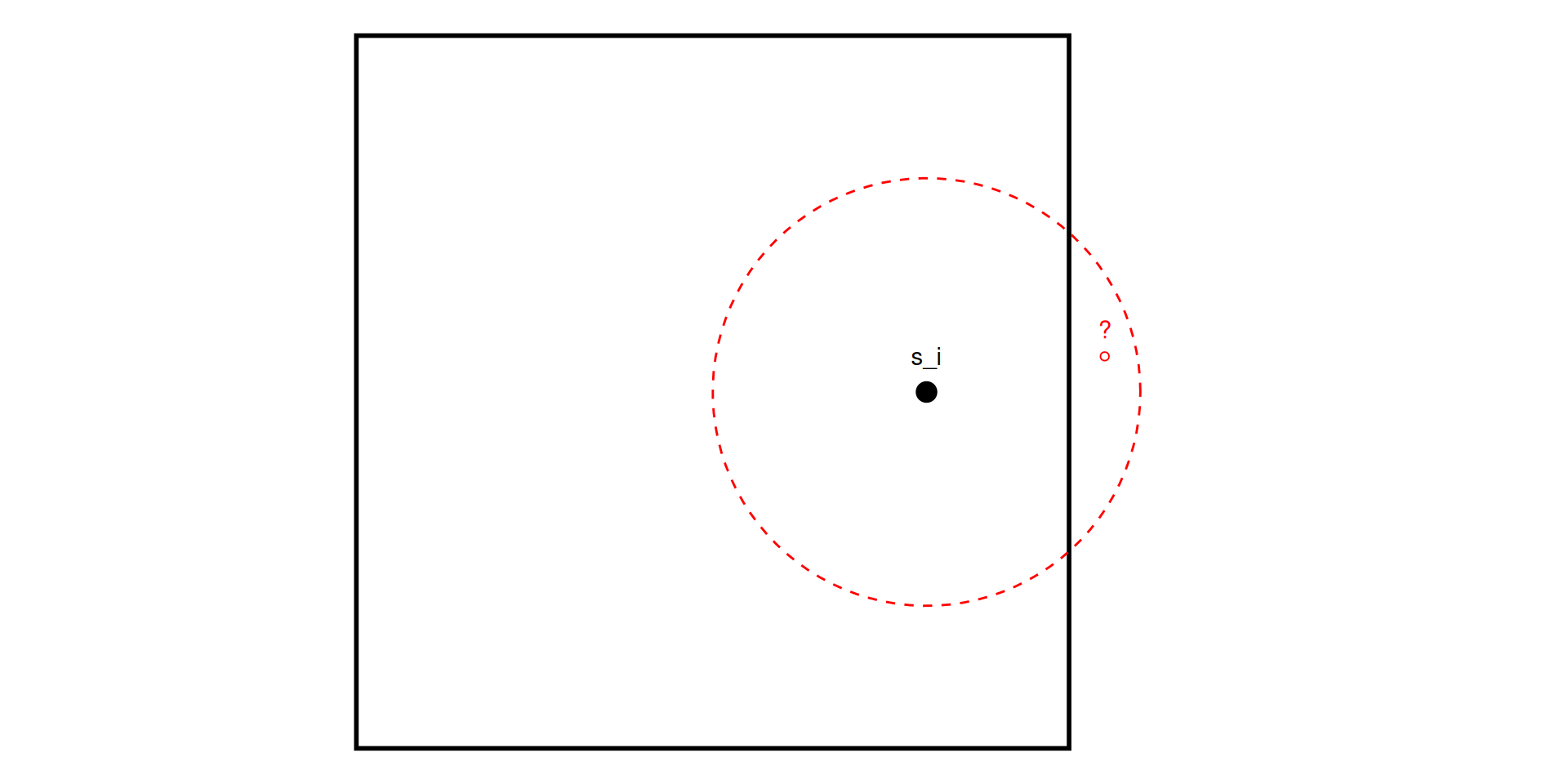

Correção de Borda

Os estimadores de Kernel sofrem viés nas margens da região \(B\) (efeito de borda), pois “perdem” massa de probabilidade para fora da janela.

Seja \(e(s_{i})=\int_{B} K(z-s)dx\) o volume do Kernel que permanece dentro de \(B\).

- Uniformemente corrigido: Divide-se a estimativa final por \(e(z)\).

\[\hat{\lambda}^{U}(z)=\frac{1}{e(z)}\sum_{i=1}^{n}K(z-s_{i})\]

- Correção de Diggle: Pondera cada ponto individualmente pelo inverso da sua massa observada.

\[\hat{\lambda}^{D}(z)=\sum_{i=1}^{n} \frac{1}{e(s_{i})} K(z-s_{i})\]

Propriedade de Segunda Ordem

Definição

Enquanto a primeira ordem trata da intensidade em um ponto, a propriedade de segunda ordem descreve a correlação entre pares de eventos.

Segundo Mateus (2013) e Pebesma; Bivand (2023), ela é representada por:

\[ \lambda (s_{i},s_{i^{'}})= \lim_{\substack{|S_{i}|\to 0 \\ |S_{i^{'}}|\to 0}} \left\{\frac{ \mathbb{E}[n(s_{i}) n(s_{i^{'}})]}{|S_{i}||S_{i^{'}}|}\right\} \]

Indica como os eventos interagem.

Independentes (Aleatoriedade Espacial Completa).

Atração (Agrupamento).

Repulsão (Regularidade).

Estacionaridade e Isotropia na Segunda Ordem

A dependência espacial simplifica sob certas condições (Diggle, 2013; Gatrell et al., 1996):

A propriedade depende apenas da diferença vetorial \(d\) (distância e direção) entre os pontos, não de suas localizações absolutas.

\[ \lambda (s_{i},s_{i^{'}})\equiv \lambda (||s_{i}-s_{i^{'}}||) \]

Se além de estacionário for isotrópico, a dependência depende apenas da distância \(r = d(s_{i},s_{i^{'}})\), ignorando a direção.

Intensidade Condicional

Corresponde à intensidade de um evento \(s_i\) dado que ocorreu um evento \(s_{i'}\) (Diggle, 2013).

\[ \lambda (s_{i}|s_{i^{'}}) = \frac{\lambda (s_{i},s_{i^{'}})}{\lambda(s_{i^{'}})} \]

Sob Independência:

Se os eventos são independentes (sem interação), a ocorrência de um não afeta o outro:

\[ \lambda (s_{i}|s_{i^{'}}) = \frac{ \lambda (s_{i})\lambda(s_{i^{'}})}{\lambda(s_{i^{'}})} =\lambda (s_{i}) \]

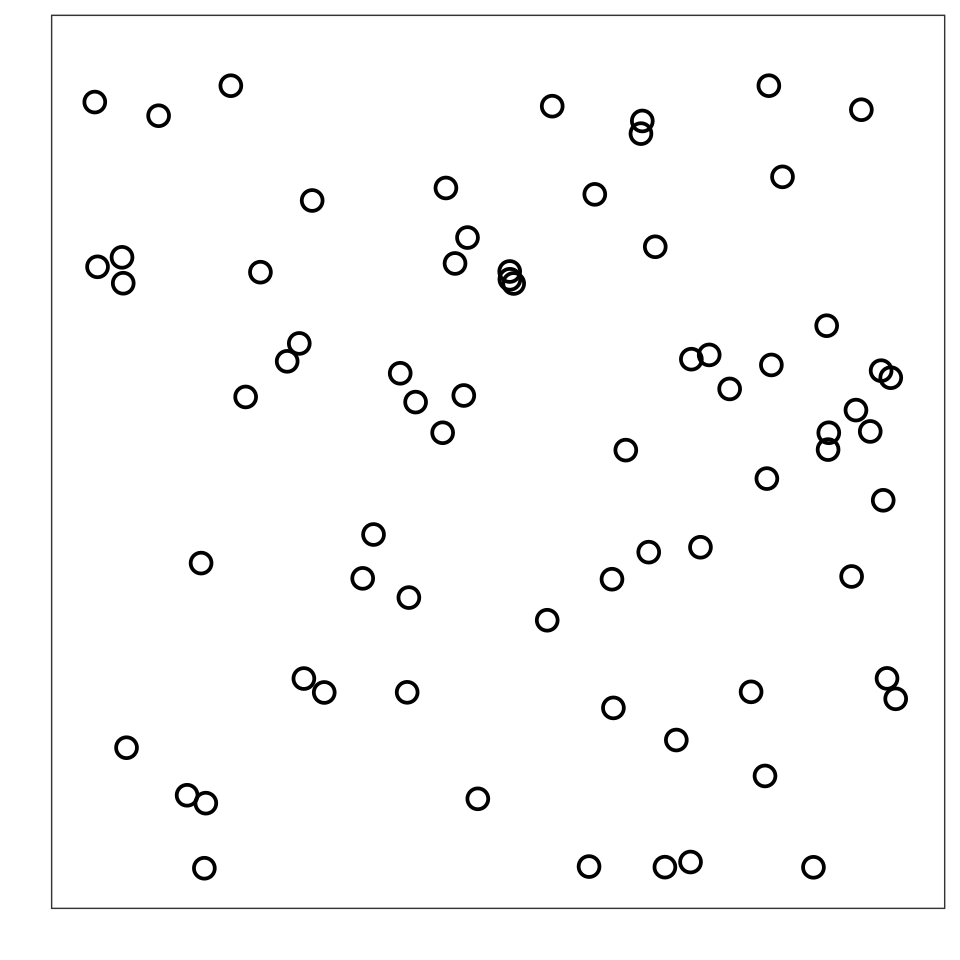

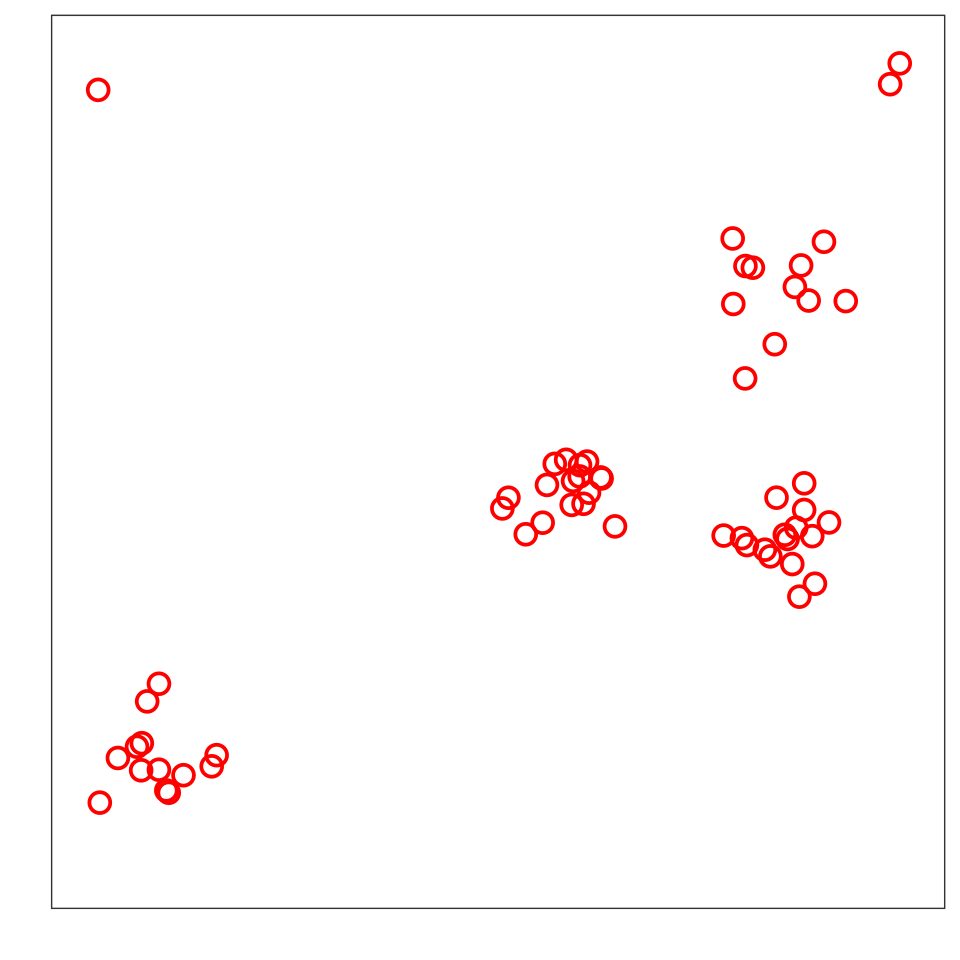

Padrões de Distribuição Espacial

Classificação dos Padrões

Um processo pontual exibe fundamentalmente três tipos de comportamento e, para identificar-os pode usar índice de Morisita (1959), de Clark; Evans (1954), de Hopkins; Skellam (1954), ou funções sumárias (Scalon, 2024).

Eventos distribuídos sem estrutura.

Média \(\approx\) Variância.

Espaçamento uniforme (repulsão).

Variância \(<\) Média (Subdispersão).

Eventos próximos uns dos outros (atração).

Variância \(>\) Média (Superdispersão).

Funções Sumárias Espaciais

Para identificar o padrão de distribuição (regular, aleatório ou agrupado), utilizamos funções que resumem a estrutura espacial em função da distância \(r\).

- Compararemos sempre com o Processo de Poisson Homogêneo (CSR) como referência nula.

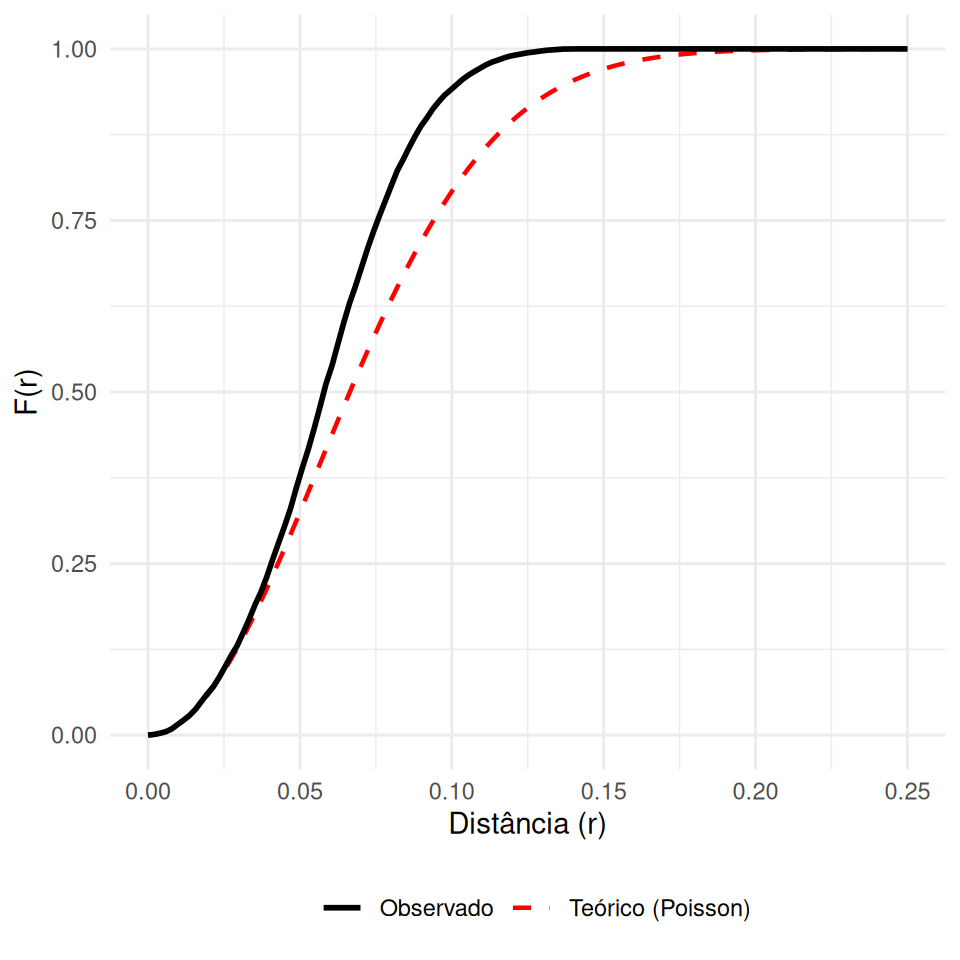

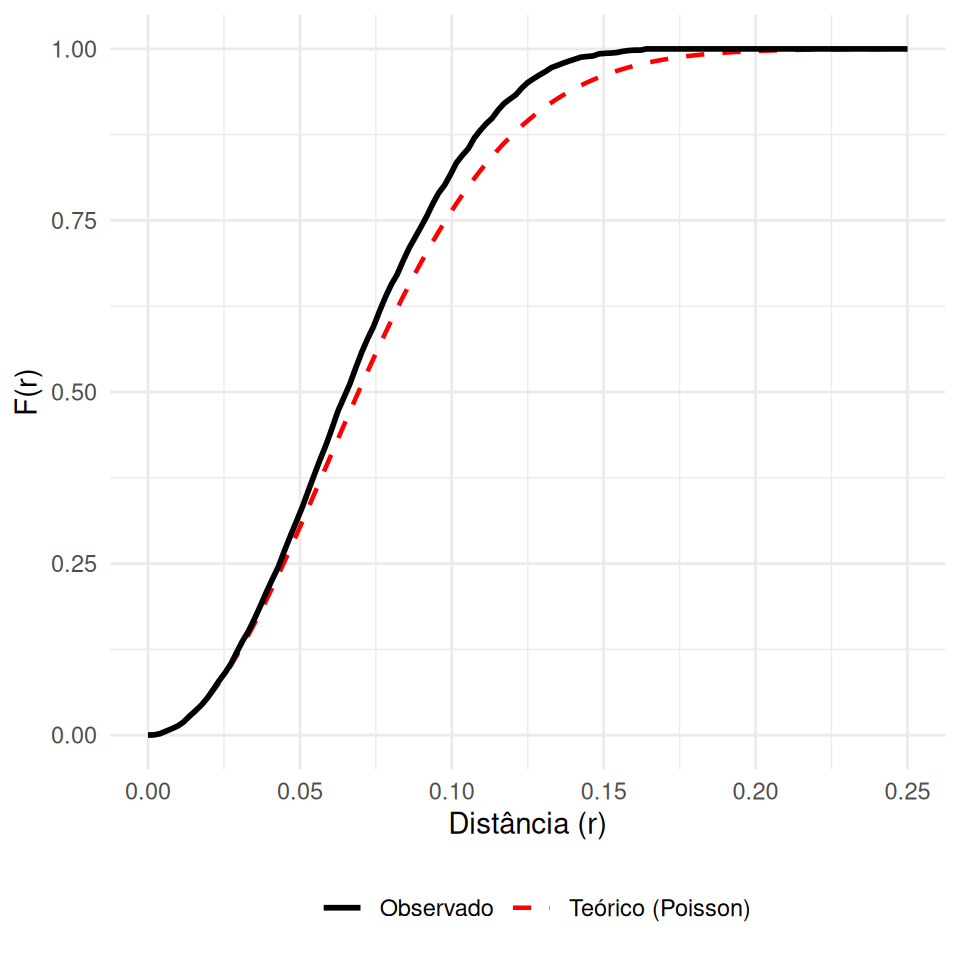

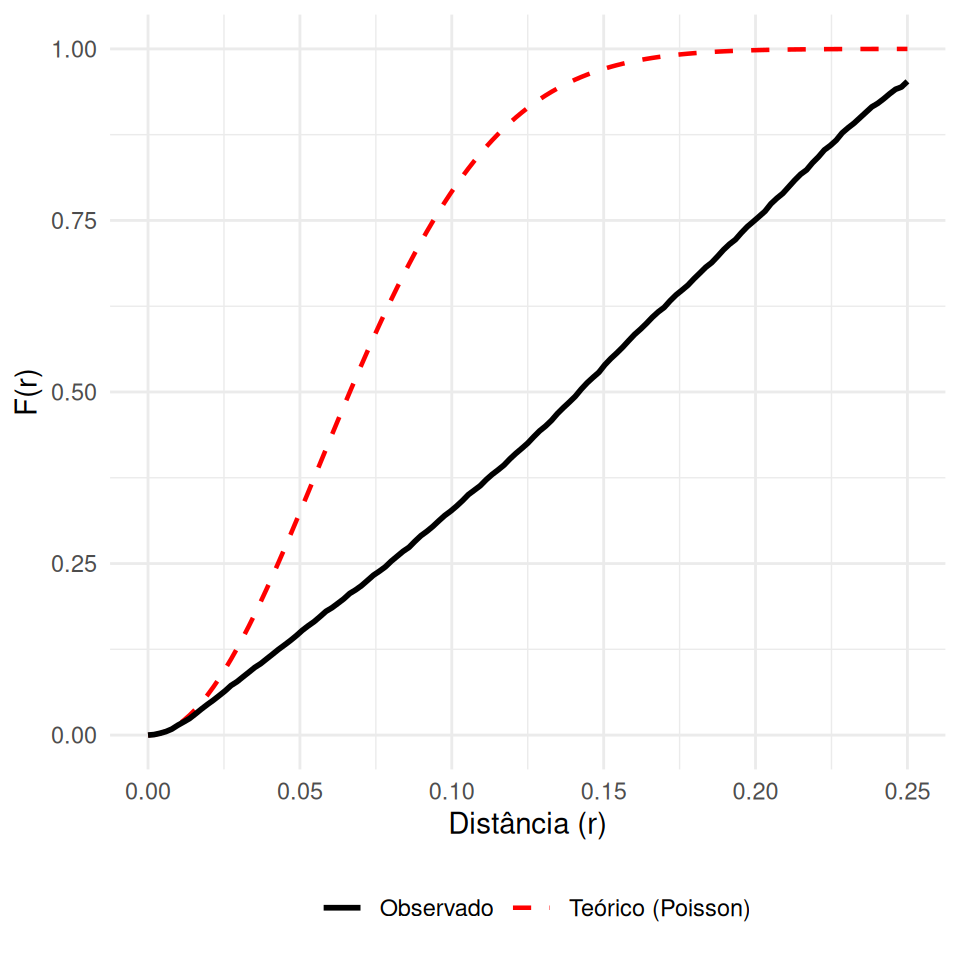

Funções de Distância:

\(F(r)\): Ponto vazio \(\to\) Evento.

\(G(r)\): Evento \(\to\) Evento.

\(J(r)\): Razão entre \(F\) e \(G\).

Mede a distribuição das distâncias de um ponto arbitrário \(z\) (no espaço vazio) até o evento mais próximo \(s_i\).

\[ F(r)= P\{d(z, s_{i})\leq r\} \]

Estimador:

\[ \hat{F}(r) = \frac{1}{n(z)} \sum_{k=1}^{K} \mathbb{I}\left\{d(z_{k}, s_{i})\leq r\right\} \]

\(\hat{F}(r) > F_{pois}(r)\): Regular (Menos espaço vazio).

\(\hat{F}(r) < F_{pois}(r)\): Agrupado (Mais espaço vazio, grandes lacunas).

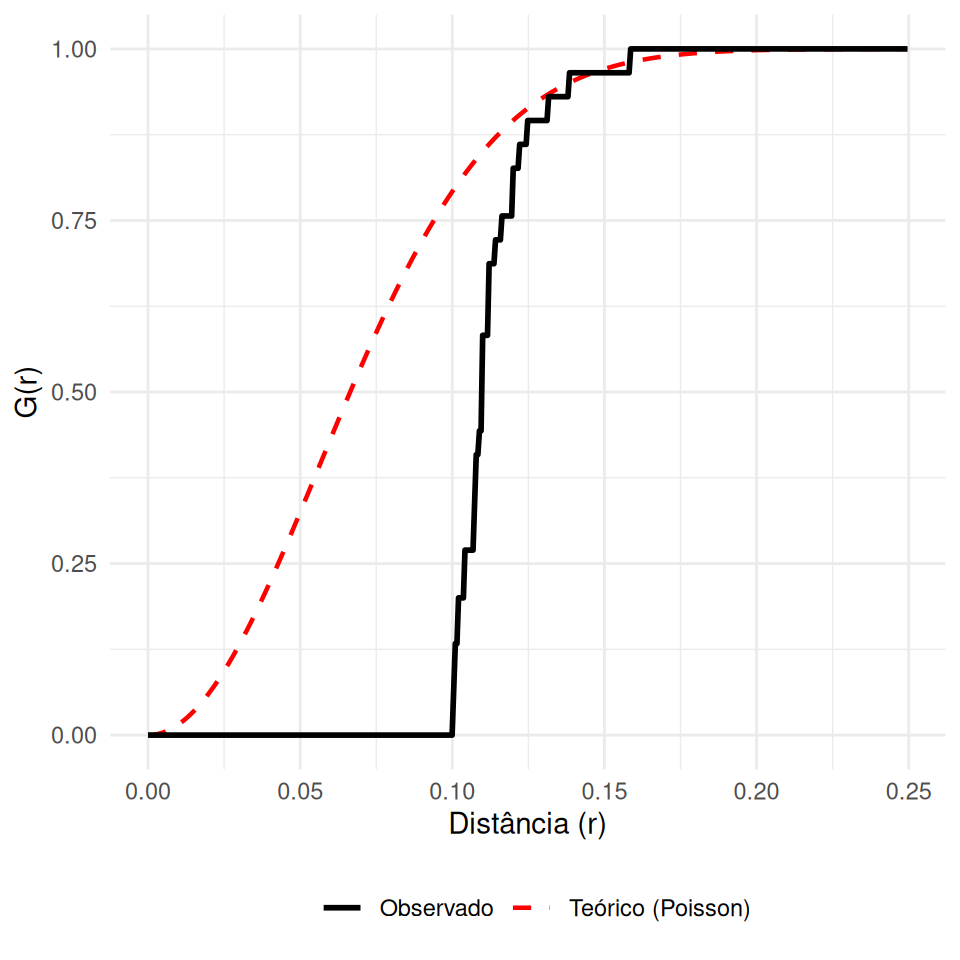

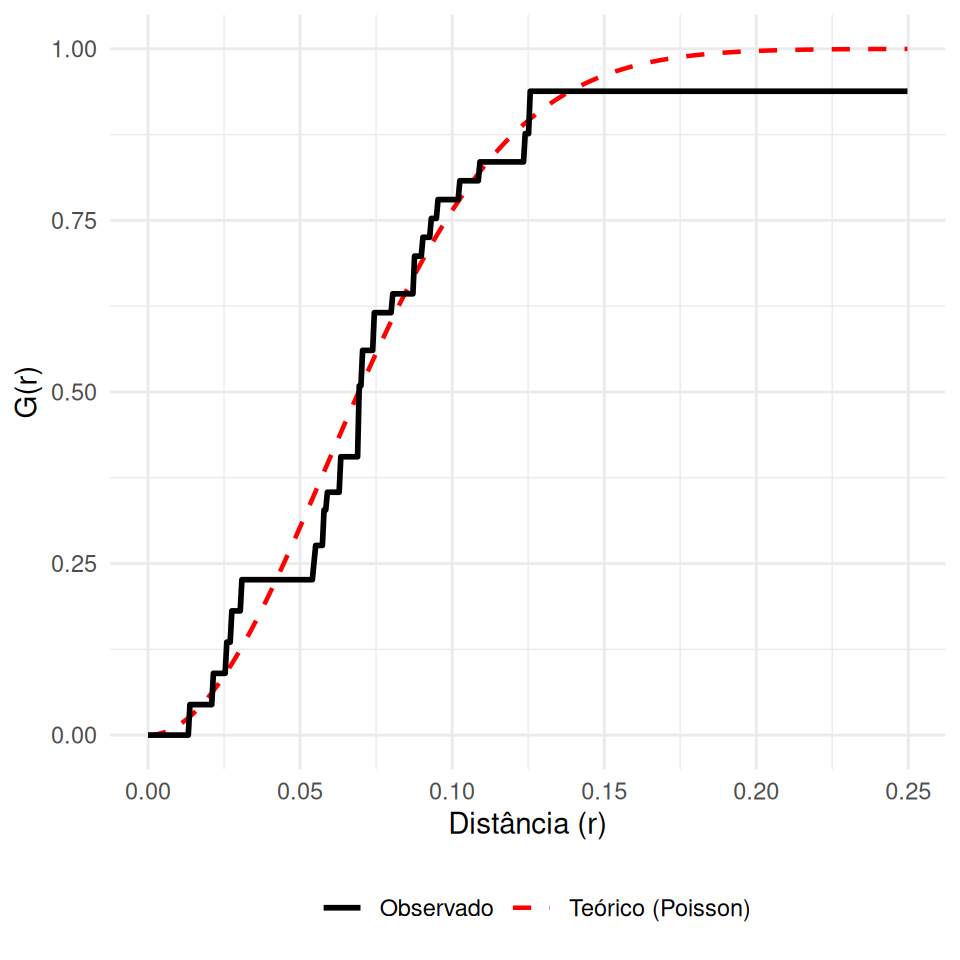

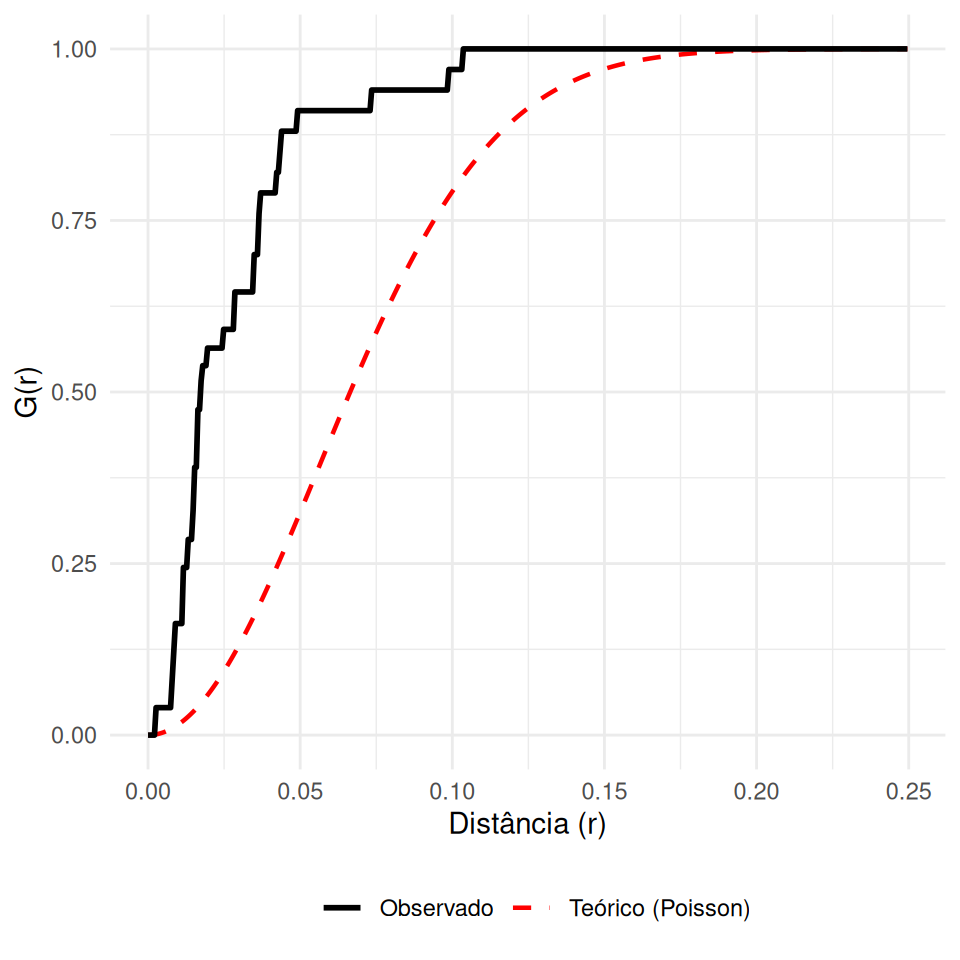

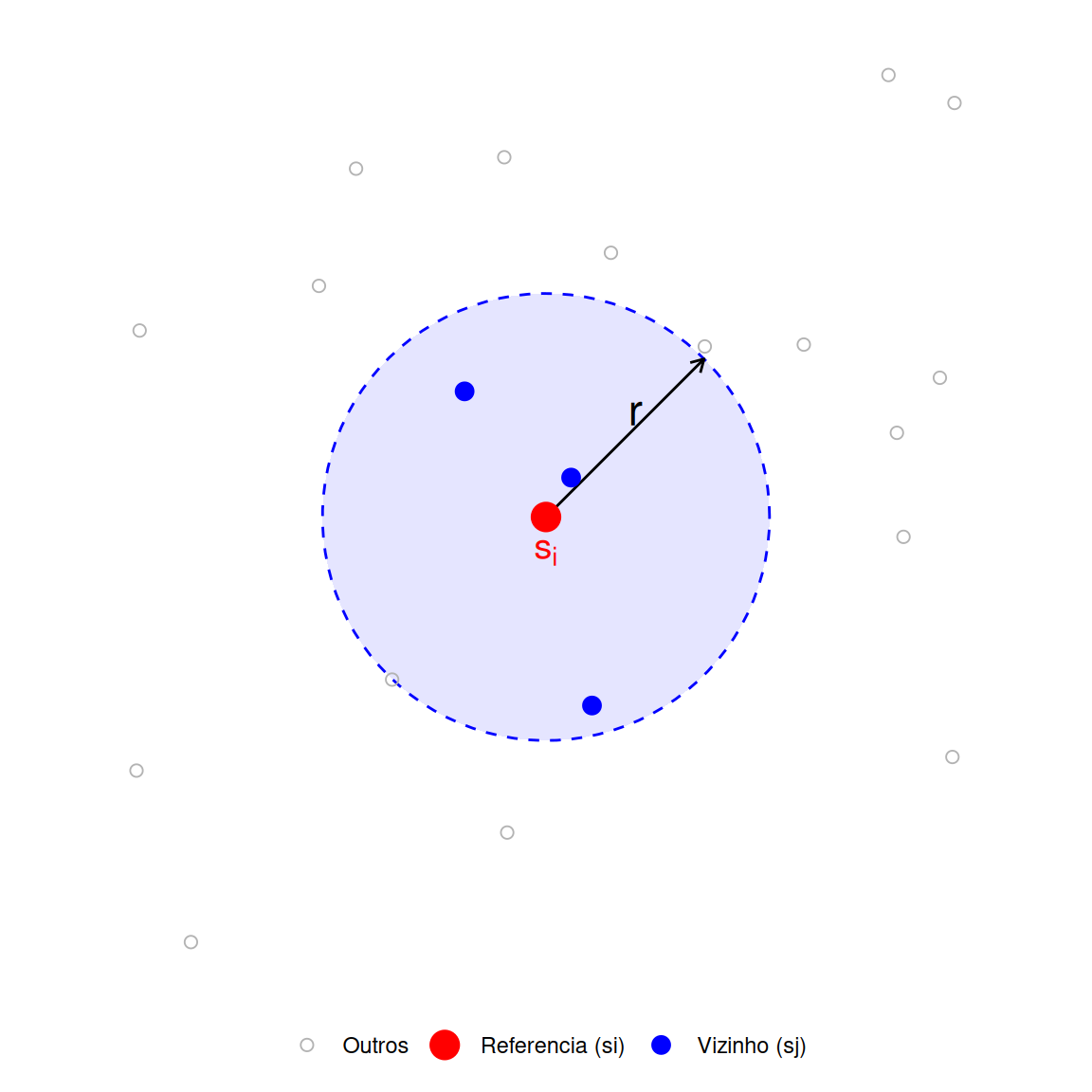

Mede a distribuição das distâncias de um evento \(s_i\) até o seu vizinho mais próximo \(s_j\).

\[G(r)=P\{d(s_{i}, s_{i^{'}} \setminus s_{i})\leq r \}\]

Estimador:

\[\hat{G} (r)=\frac{1}{n(s)} \sum_{i} \mathbb{I}\left\{d_{min}\leq r\right\}\]

\(\hat{G}(r) < G_{pois}(r)\): Regular (Vizinhos afastados).

\(\hat{G}(r) > G_{pois}(r)\): Agrupado (Vizinhos muito próximos).

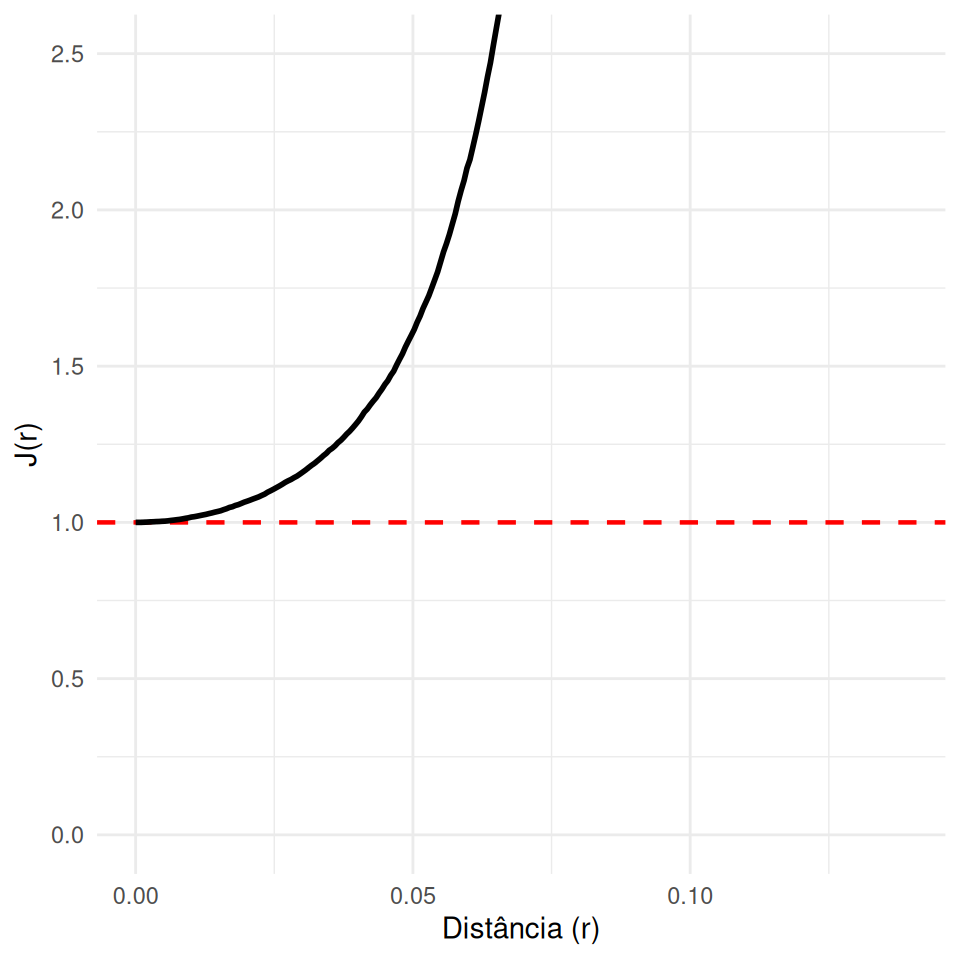

- Combina as informações de espaço vazio (\(F\)) e interação (\(G\)) em um único indicador sem viés.

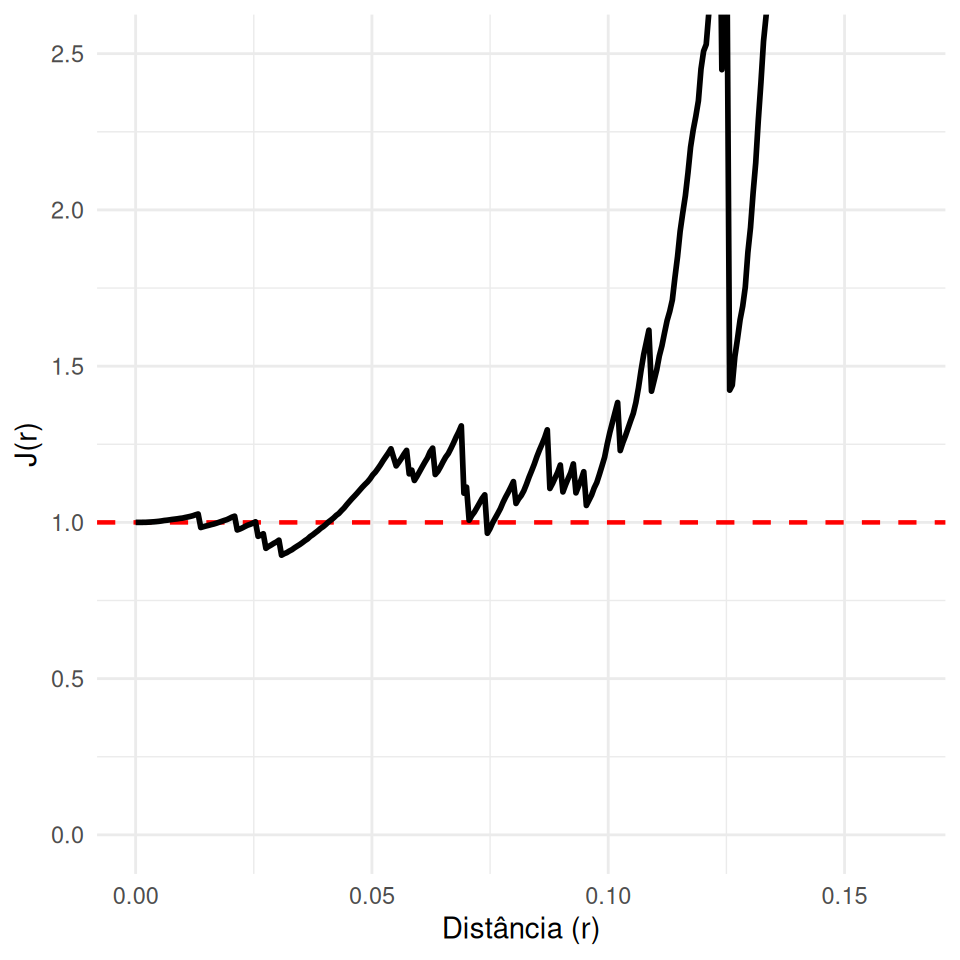

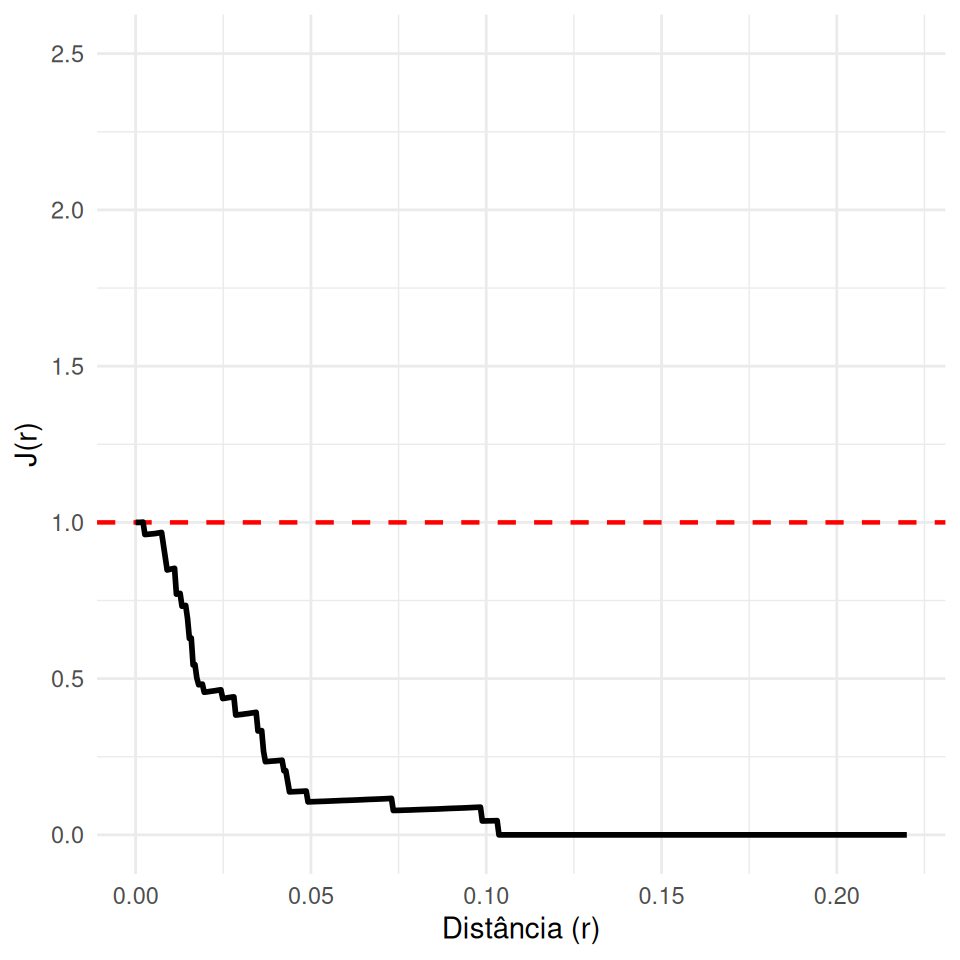

\[J(r) = \frac{1-G(r)}{1-F(r)}\]

Regular (Inibição): \(J(r) > 1\)

- Eventos evitam ficar próximos, mas preenchem o espaço uniformemente.

Aleatório (Poisson): \(J(r) = 1\)

- Independência total.

Agrupado (Cluster): \(J(r) < 1\)

- Eventos próximos uns dos outros, deixando grandes vazios.

Estimadores de distância sofrem viés nas margens da região de estudo (censura).

A distância observada para o vizinho mais próximo dentro da janela (\(d_{min}\)) pode ser maior do que a distância real para um vizinho fora da janela.

Isso superestima as distâncias e distorce \(F\) e \(G\).

Função \(K(r)\) de Ripley

A função \(K(r)\) estima o número esperado de vizinhos extras dentro de uma distância \(r\) de um evento arbitrário, normalizado pela intensidade \(\lambda\).

\[ K(r) = \frac{ \mathbb{E}[\text{Nº de eventos extras dentro da dist. } r]}{\lambda} \]

Estimador:

\[ \hat{K}(r)=\frac{1}{\hat{\lambda}^2 |B|}\sum_{i \neq j} \mathbb{I} (d_{ij} \leq r) e_{ij} \]

\(e_{ij}\): Correção de borda.

\(|B|\): Área da região.

Regular: \(\hat{K}(r) < \pi r^2\) (Menos vizinhos que o esperado).

Aleatório: \(\hat{K}(r) \approx \pi r^2\).

Agrupado: \(\hat{K}(r) > \pi r^2\) (Mais vizinhos que o esperado).

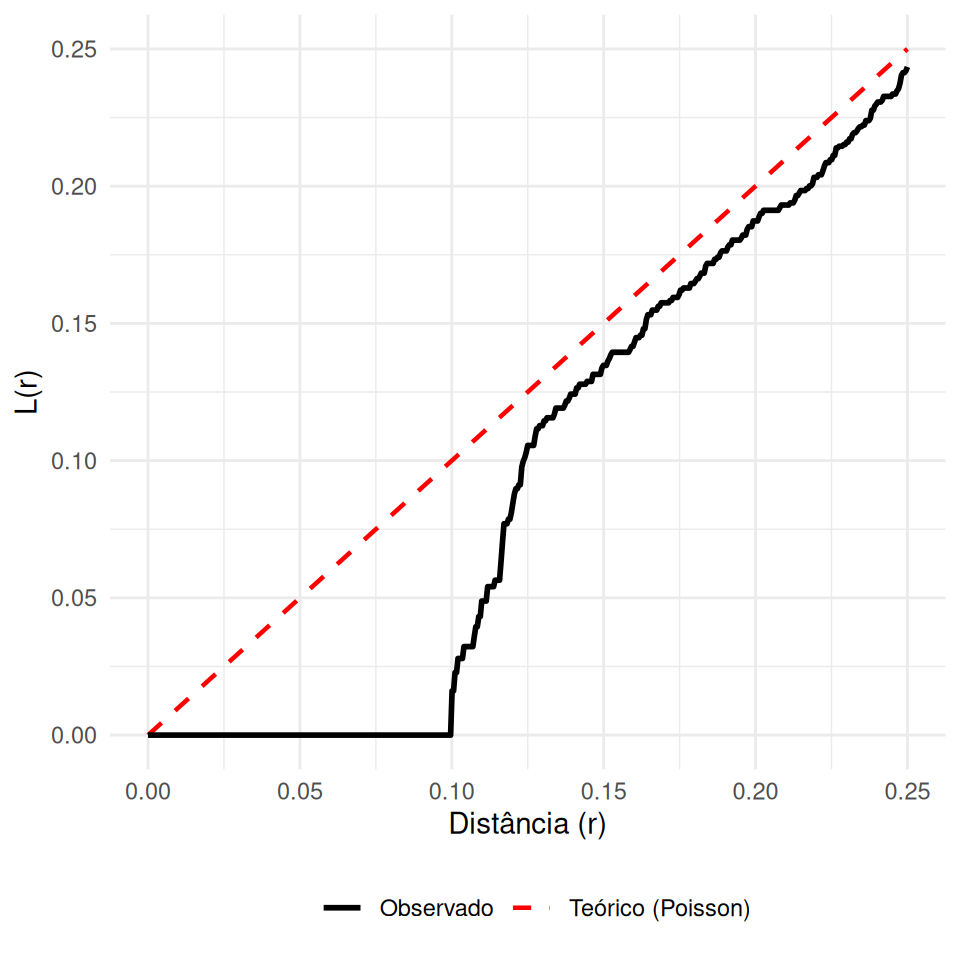

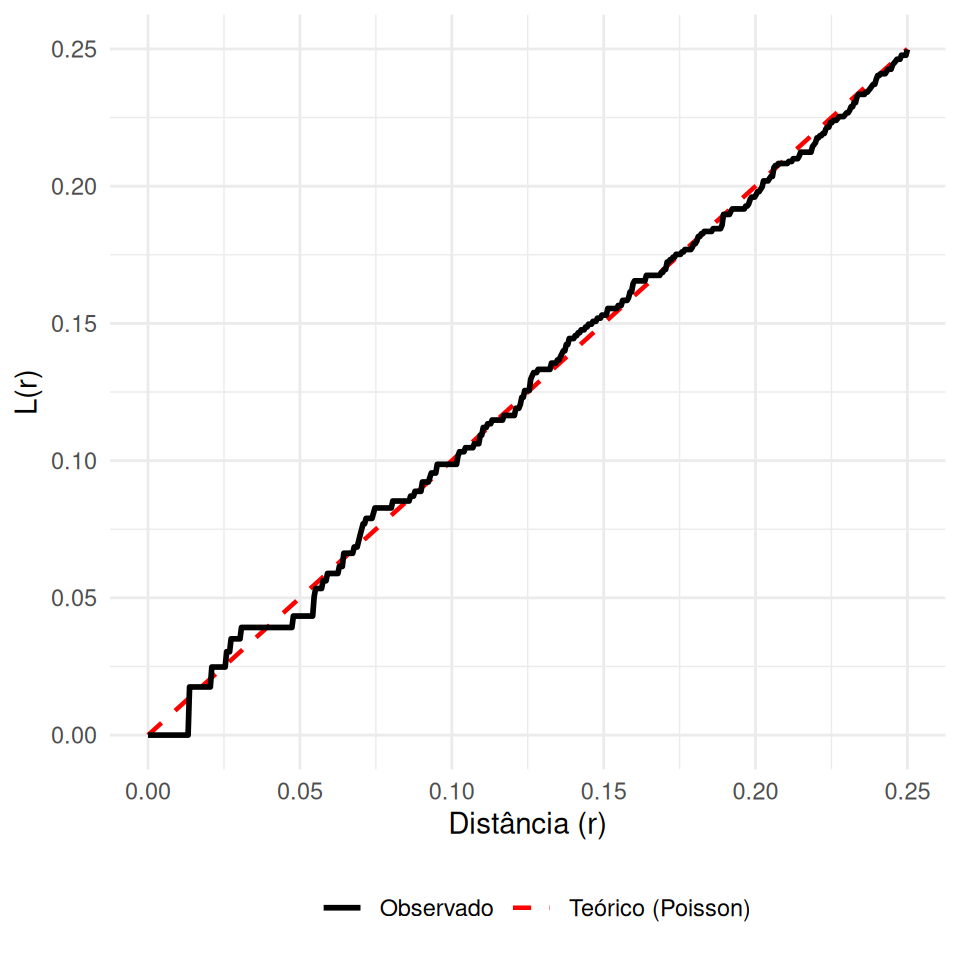

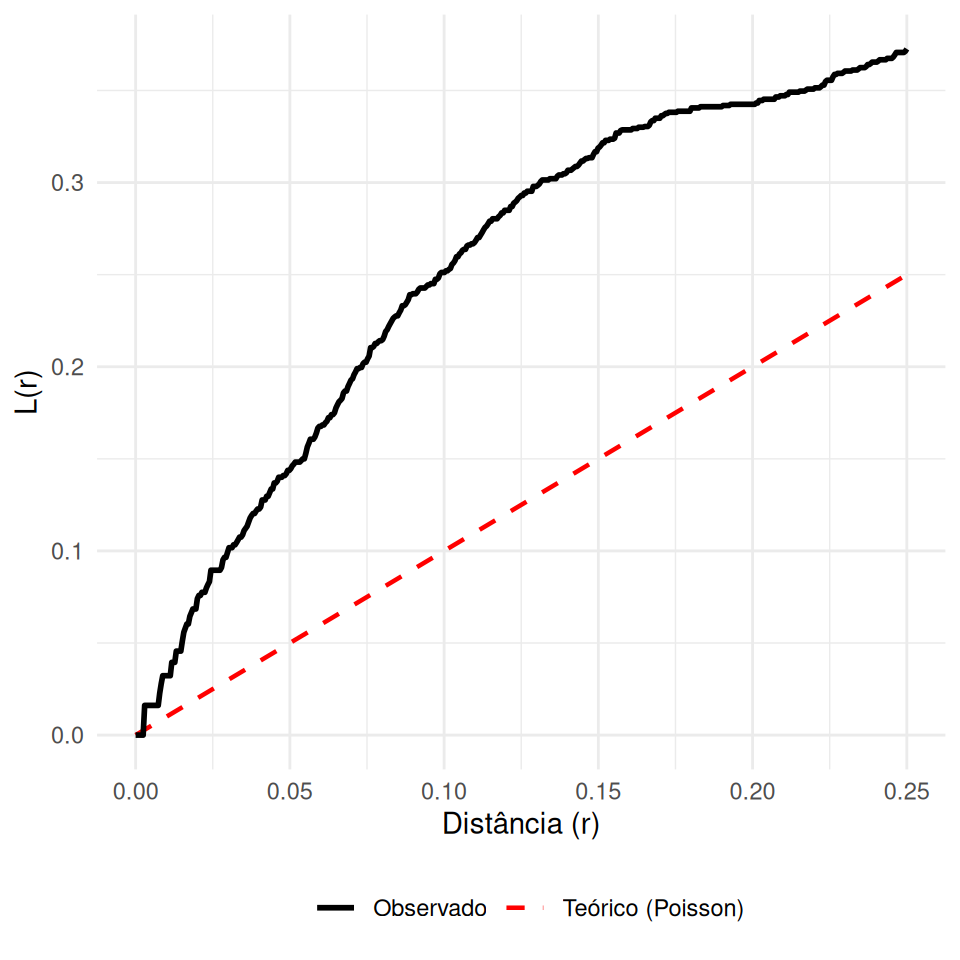

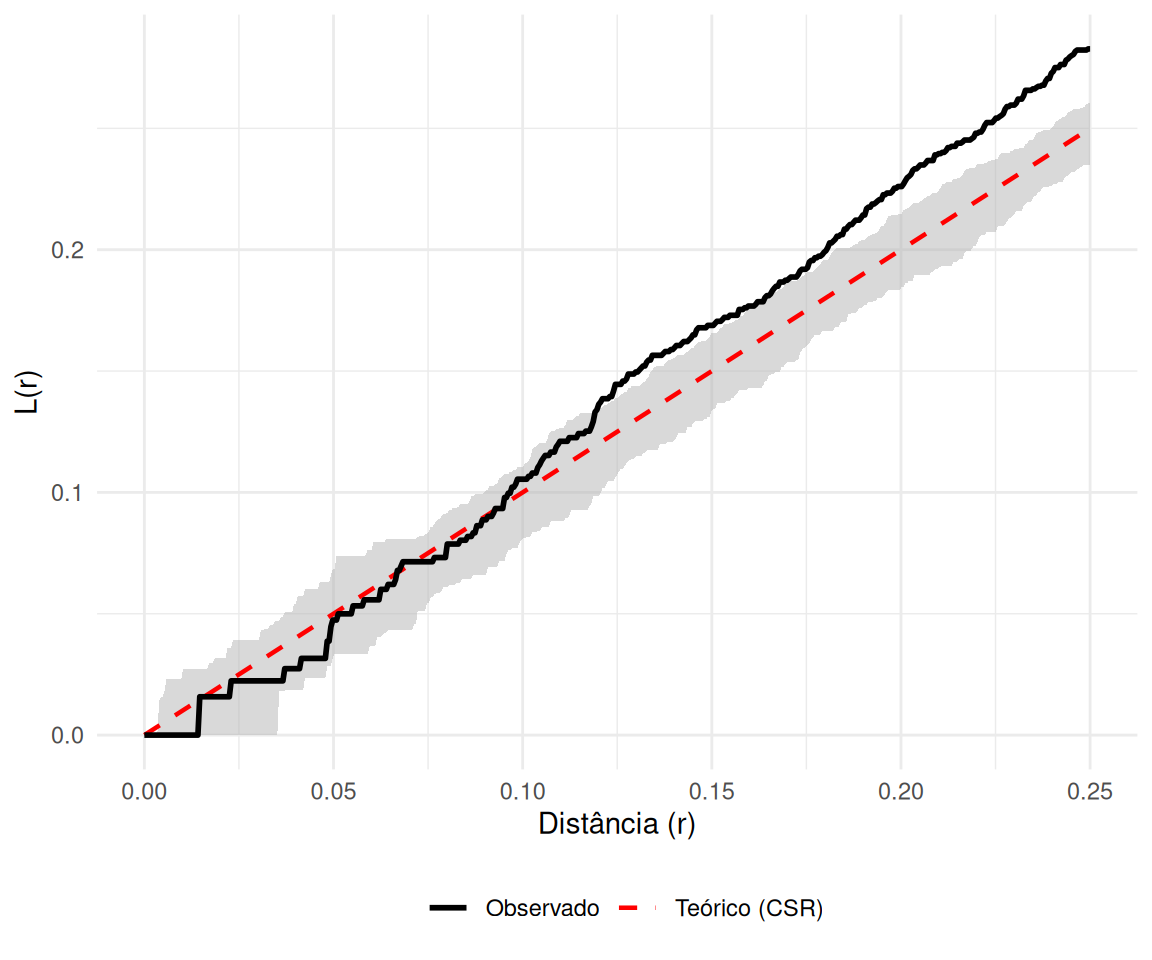

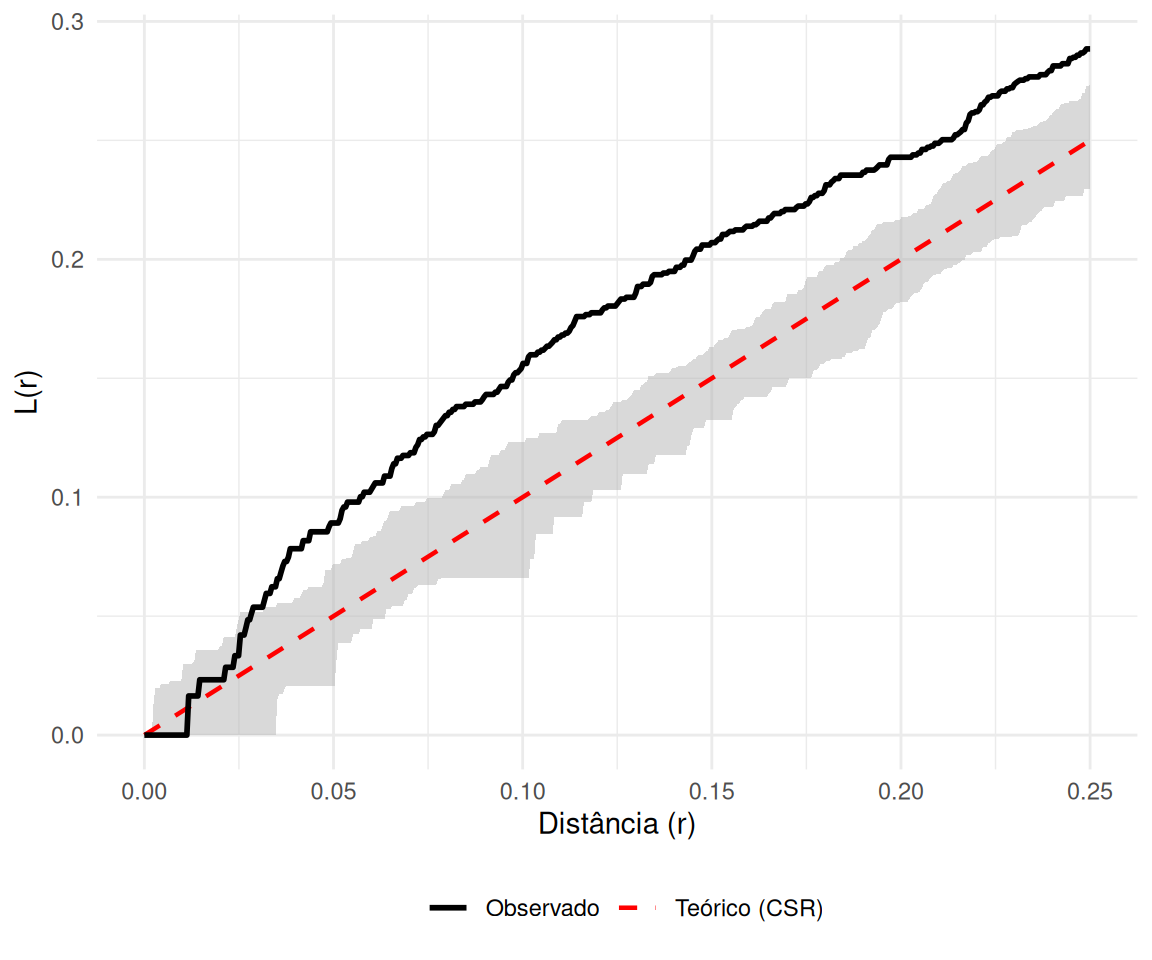

A função \(L(r)\) é uma transformação linearizante da função \(K(r)\), proposta para estabilizar a variância e facilitar a interpretação visual.

\[L(r)=\sqrt{\frac{K(r)}{\pi}}\]

Por que transformar?

- Sob aleatoriedade (Poisson), \(K(r) = \pi r^2\). Ao aplicar a transformação:

\[L_{pois}(r) = \sqrt{\frac{\pi r^2}{\pi}} = r\]

Regular: \(L(r) < r\) (Abaixo da diagonal).

Aleatório: \(L(r) \approx r\) (Sobre a diagonal).

Agrupado: \(L(r) > r\) (Acima da diagonal).

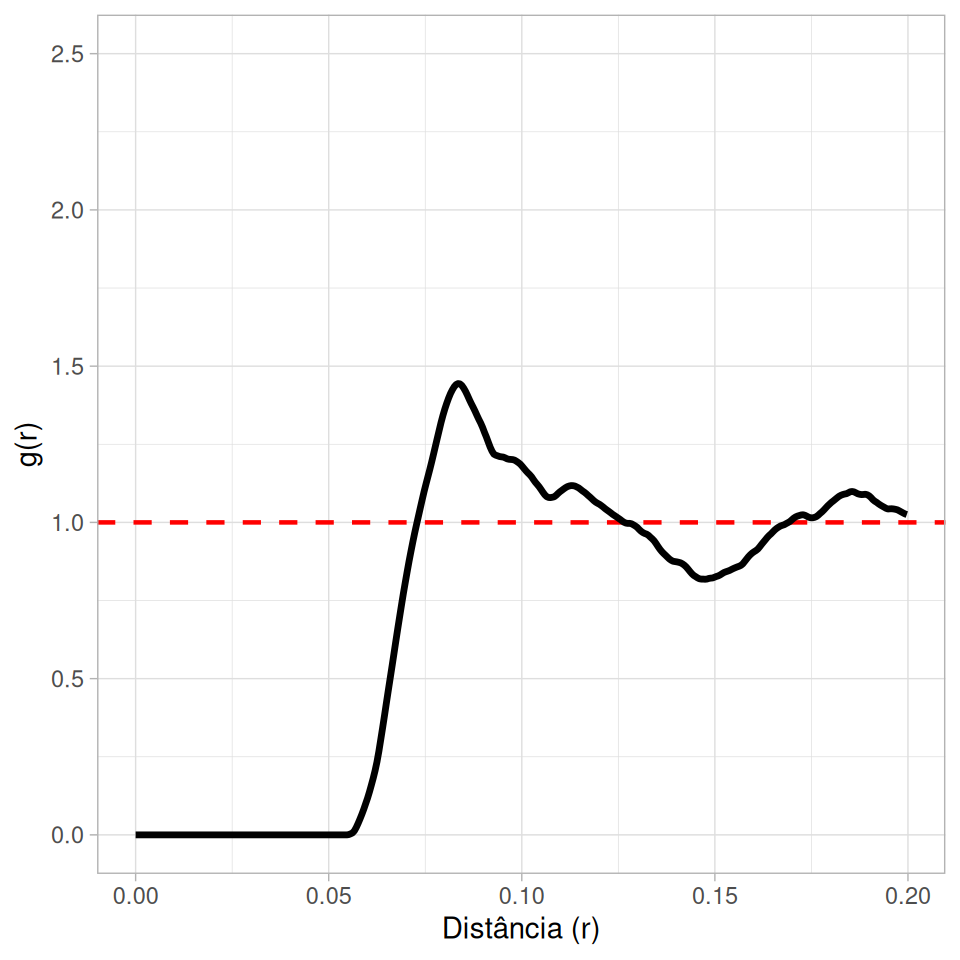

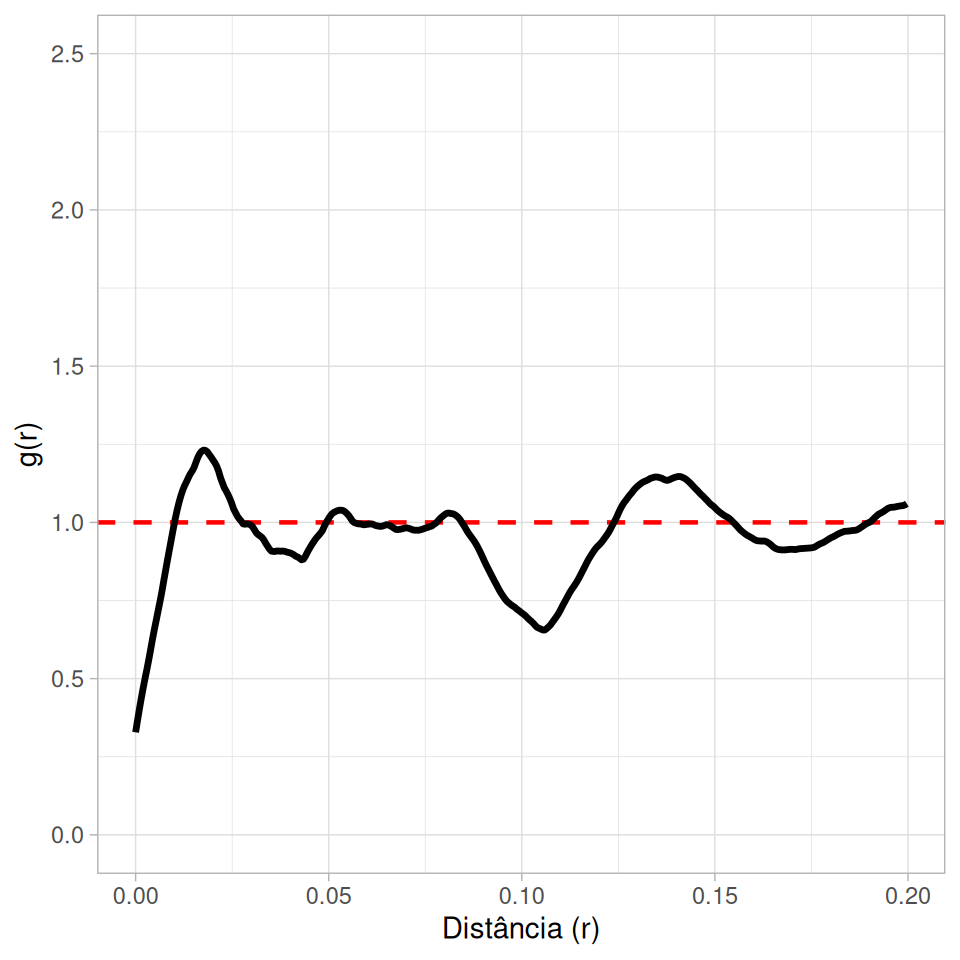

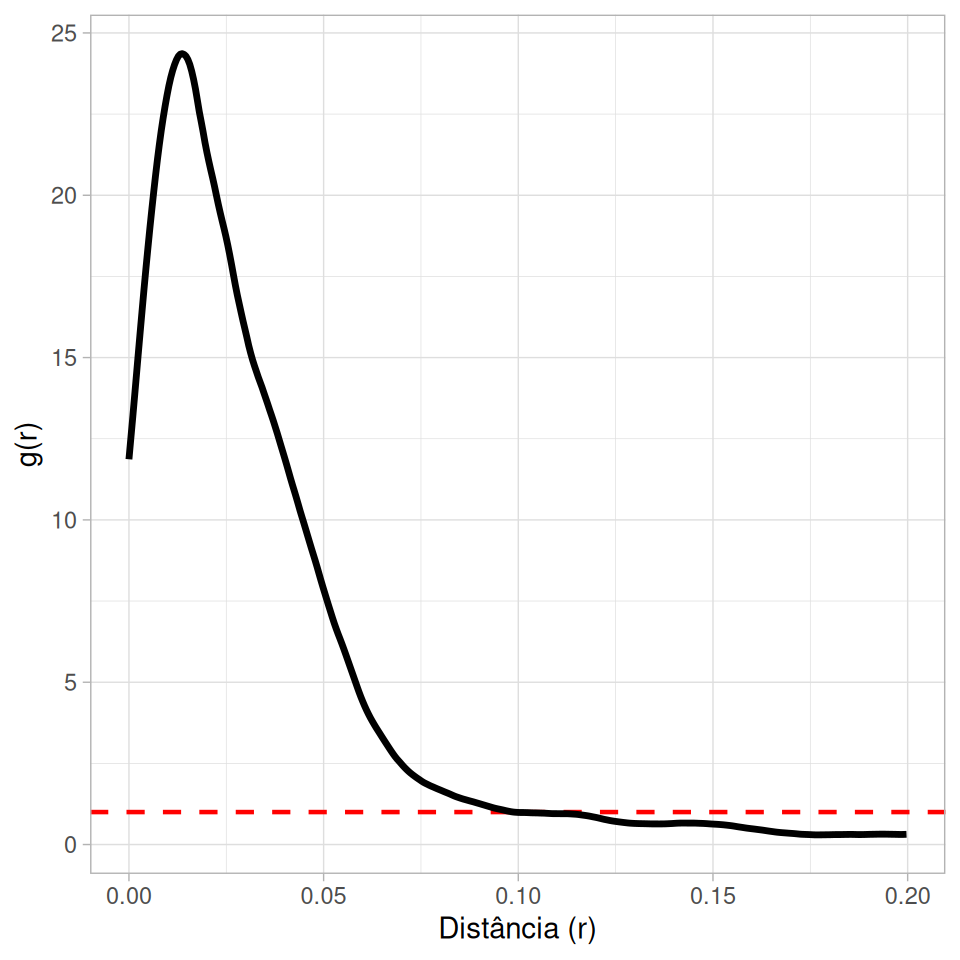

A função \(g(r)\) (Pair Correlation Function - PCF) não é cumulativa. Ela descreve a probabilidade de encontrar um par de pontos separados por uma distância exata \(r\).

\[g(r) = \frac{K'(r)}{2\pi r}\]

É análoga a uma função densidade de probabilidade.

\(g(r) = 1\): Aleatoriedade.

\(g(r) > 1\): Agrupamento na distância \(r\).

\(g(r) < 1\): Inibição na distância \(r\).

Muito útil para detectar escalas específicas de interação (ex: inibição a curta distância mas atração a média distância).

Funções Sumárias Não-Homogêneas

O Desafio da Não-Estacionariedade

As funções clássicas \(K, L, g, F, G, J\) assumem que a intensidade \(\lambda\) é constante (Homogeneidade).

Se \(\lambda(s)\) varia no espaço (tendência), as funções clássicas confundem essa variação de primeira ordem com agrupamento ou repulsão (segunda ordem).

Solução: Utilizar versões não-homogêneas que ponderam cada evento pelo inverso da sua intensidade local \(\lambda(s_i)\).

Função \(K_{inhom}(r)\)

Generalização da função de Ripley para processos com intensidade variável.

\[ K_{inhom} (r) = \frac{1}{|B|} \mathbb{E} \left[\sum_{s_{i}}^{n}\sum_{s_{i^{'}} \setminus \{s_{i}\}} \frac{ \mathbb{I}\left(||s_{i}-s_{i^{'}}||\leq r\right)}{\lambda (s_{i}) \lambda (s_{i^{'}})} \right] \]

Estimador:

\[ \hat{K}_{inhom} (r) = \frac{1}{|B|}\sum_{i}\sum_{i^{'}} \frac{ \mathbb{I}\left(||s_{i}-s_{i^{'}}||\leq r\right)}{\hat{\lambda} (s_{i})\hat{\lambda} (s_{i^{'}})e_{ii^{'}}} \]

- A ponderação por \(1/(\lambda(s_i)\lambda(s_j))\) remove o efeito da tendência, isolando a interação pura.

Função \(L_{inhom}(r)\)

Transformação linearizante para estabilização da variância, análoga ao caso homogêneo.

\[ L_{inhom}(r)=\sqrt{\frac{K_{inhom}(r)}{\pi}} \]

Estimador: \[ \hat{L}_{inhom}(r)=\sqrt{\frac{\hat{K}_{inhom}(r)}{\pi}} \]

Interpretação:

\(\hat{L}_{inhom}(r) - r > 0\): Agrupamento (além do explicado pela tendência).

\(\hat{L}_{inhom}(r) - r < 0\): Inibição.

Função \(g_{inhom}(r)\) (Correlação Par)

A função de correlação par não-homogênea descreve a probabilidade de encontrar pares de pontos a uma distância \(r\), ajustada pela intensidade local.

\[ g_{inhom}(r) = \frac{K_{inhom}^{'}(r)}{2\pi r} \]

Estimador: \[ \hat{g}_{inhom}(r) = \frac{\hat{K}_{inhom}^{'}(r)}{2\pi r} \]

É a ferramenta preferida para distinguir entre agrupamento real (interação) e agrupamento virtual (causado apenas por alta intensidade local \(\lambda(s)\)).

Funções de Distância Não-Homogêneas

Generalizações para \(F, G\) e \(J\) que levam em conta a intensidade mínima \(\lambda_{min}\) para reponderar as distâncias.

\[ F_{inhom} (r) = 1- \mathbb{E}\left[\prod_{s_{i}} \left(1-\frac{\lambda_{\min}}{\lambda (s_{i})}\right)\right] \]

\[ G_{inhom} (r) = 1- \mathbb{E}\left[\prod_{s_{i}} \left(1-\frac{\lambda_{\min}}{\lambda (s_{i})}\right) \middle\lvert z\in S \right] \]

\[ J_{inhom}(r)= \frac{1-G_{inhom}(r)}{1-F_{inhom} (r)}, \quad \text{para } F_{inhom} (r) < 1 \]

Interpretação e Diagnóstico de Padrões

Quadro Resumo de Interpretação

Como interpretar as funções \(F, G, J, K, L, g\) em relação ao modelo nulo (Poisson)?

| Padrão | \(F(r)\) | \(G(r)\) | \(J(r)\) | \(K(r)\) | \(L(r)\) | \(g(r)\) |

|---|---|---|---|---|---|---|

| Aleatório | \(F(r)\equiv F_{pois}\) | \(G(r)\equiv G_{pois}\) | \(J(r)\equiv 1\) | \(K(r)\equiv K_{pois}\) | \(L(r)\equiv r\) | \(g(r)\equiv 1\) |

| Agrupado | \(F(r)<F_{pois}\) | \(G(r)>G_{pois}\) | \(J(r)< 1\) | \(K(r)>K_{pois}\) | \(L(r) > r\) | \(g(r)> 1\) |

| Regular | \(F(r)>F_{pois}\) | \(G(r)<G_{pois}\) | \(J(r)> 1\) | \(K(r)<K_{pois}\) | \(L(r) < r\) | \(g(r)< 1\) |

Nota

A regra de interpretação é a mesma para as versões não-homogêneas (\(F_{inhom}, K_{inhom}, \dots\)).

O Problema da Tendência vs. Dependência

A presença de tendência (intensidade variável) pode enganar as funções sumárias.

Imagine plantas concentradas onde o solo é fértil.

Visão Ingênua: “Estão agrupadas!” (Dependência).

Realidade: Estão apenas seguindo o recurso (Tendência). Não há atração entre elas.

Funções como \(L(r)\) podem indicar agrupamento (\(L(r) > r\)) mesmo sem interação real entre os pontos.

Para distinguir se o desvio observado é significativo (dependência real) ou apenas ruído/tendência, construímos envelopes de confiança.

Simulamos \(N\) vezes o processo nulo (CSR ou Poisson Não-Homogêneo).

Calculamos a função (ex: \(L(r)\)) para cada simulação.

Definimos os limites Mínimo (Lo) e Máximo (Hi) das simulações.

Dentro do Envelope: Aceitamos a hipótese nula (Ausência de interação). O padrão é explicado pela aleatoriedade ou tendência.

Fora do Envelope: Rejeitamos a nula. Existe dependência espacial significativa (atração ou repulsão).

Visualização: Diagnóstico com Envelopes

Modelos de Processos Pontuais

Explicar por que os eventos ocorrem onde ocorrem.

Quantificar a influência de fatores ambientais (covariáveis).

Capturar a estrutura de dependência residual.

Modelos Poisson: Independência (com ou sem tendência).

Modelos Cox: Agrupamento (Clusters) devido a fatores latentes.

Modelos Gibbs: Interação direta (geralmente inibição/repulsão).

Modelos de Poisson

Assumem independência entre os eventos. A presença de um evento não atrai nem repele outros.

Intensidade constante: \(\lambda(s) = \lambda\).

Padrão Aleatório (CSR).

Função de densidade:

\[f(s)= \lambda^{n(s)}\exp\{\left(1-\lambda\right)|B|\}\]

A intensidade varia no espaço: \(\lambda(s)\).

Explica a tendência espacial através de covariáveis.

Modelando a Intensidade (Poisson não homogêneo)

A intensidade \(\lambda(s)\) é modelada como uma função log-linear de covariáveis \(Z(s)\) (ex: altitude, pH do solo):

\[ \lambda(s) = \exp \left(\alpha + \theta_1 Z_1(s) + \dots + \theta_n Z_n(s) \right) \]

Podemos usar as próprias coordenadas \((x, y)\) como preditores para capturar tendências espaciais suaves.

Linear: \(\lambda(s) = \exp(\theta_0 + \theta_1 x + \theta_2 y)\)

Quadrática: \(\lambda(s) = \exp(\theta_0 + \theta_1 x + \theta_2 y + \theta_3 x^2 + \theta_4 y^2 + \theta_5 xy)\)

- Se os coeficientes \(\theta\) forem significativos, o padrão observado é explicado por fatores externos (recursos), não por interação social entre os pontos.

Para capturar formas mais complexas e orgânicas da tendência espacial, generalizamos o modelo log-linear utilizando funções de suavização (Splines).

A intensidade \(\lambda(s)\) é modelada como uma soma de funções suaves das covariáveis ou coordenadas:

\[ \lambda(s) = \exp \left( \alpha + \sum_{j=1}^{p} f_j(Z_j(s)) \right) \]

Onde \(f_j(\cdot)\) são funções de suavização (ex: Thin Plate Splines, Cubic Splines) estimadas a partir dos dados.

Ao contrário dos polinômios globais, os Splines ajustam polinômios de baixo grau em segmentos locais da região, garantindo suavidade nas junções (nós).

Tendência Espacial 2D: \(\lambda(s) = \exp(f(x, y))\).

- \(f(x,y)\) é uma superfície suave (como um lençol deformável) que se adapta à densidade local dos pontos.

GLM (Polinomial): Assume uma forma global rígida (ex: uma parábola cobrindo toda a floresta).

- R:

ppm(X ~ x + y + I(x^2))

- R:

GAM (Splines): Ajusta-se localmente aos “montes e vales” da intensidade.

- R:

ppm(X ~ s(x, y))(via pacotemgcv) oubs(x)(B-splines).

- R:

Se \(f_j\) for linear, recuperamos o modelo Poisson Inomogêneo padrão.

O uso de Splines reduz o viés de especificação do modelo, permitindo detectar aglomerados causados por heterogeneidade ambiental complexa que polinômios simples não capturam.

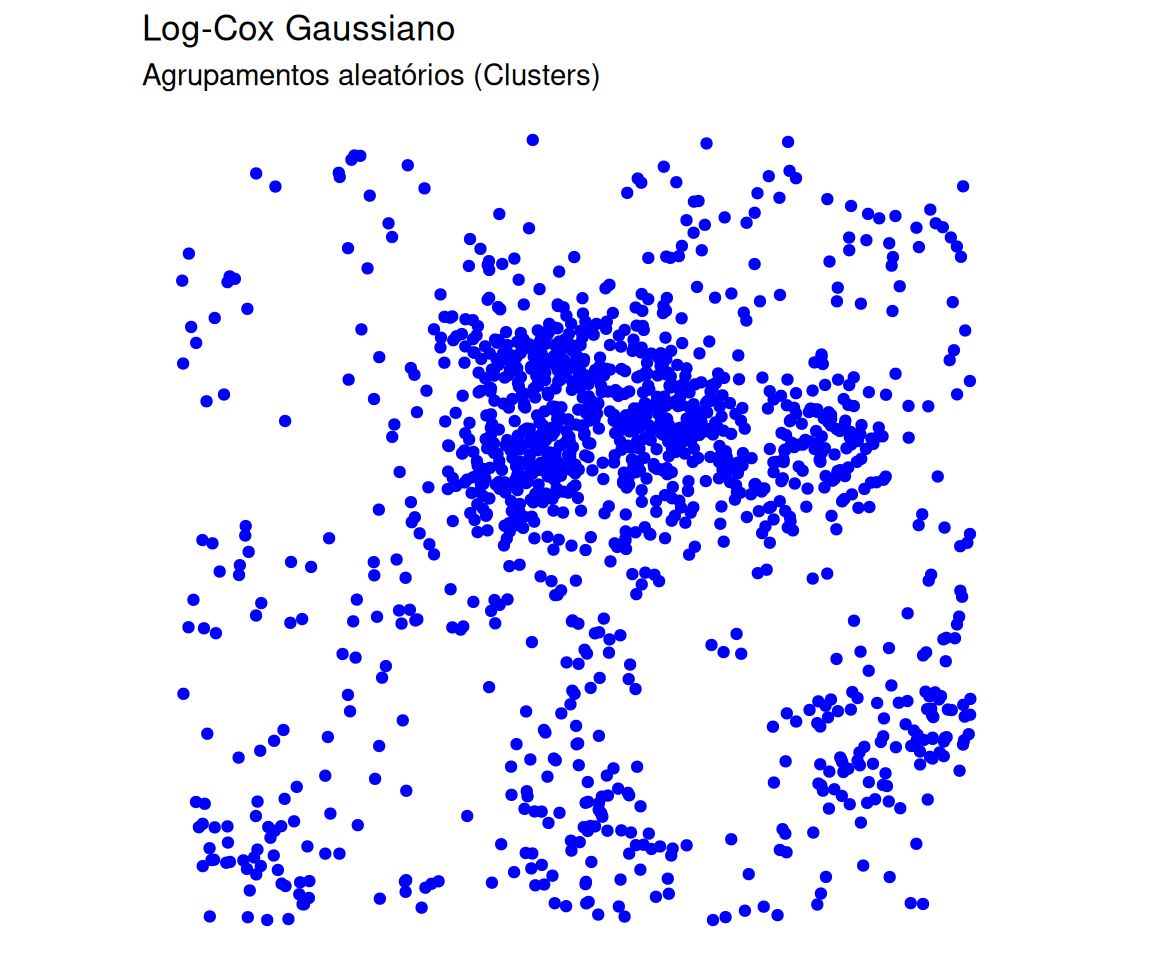

Modelos de Cox

E quando as covariáveis não explicam tudo?

O Problema da Heterogeneidade Não Observada

Muitas vezes, existe variabilidade na intensidade causada por fatores ambientais não medidos ou desconhecidos. Isso cria uma aparência de agrupamento (Cluster).

Definição: Um processo de Cox é um processo de Poisson onde a própria intensidade \(\Lambda(s)\) é uma variável aleatória.

- É um processo “duplamente estocástico”: Aleatoriedade na intensidade + Aleatoriedade nos pontos.

Estrutura do Modelo de Cox

A intensidade aleatória \(\Lambda(s)\) é decomposta em:

Tendência Determinística: Explicada por covariáveis observadas \(Z(s)\).

Campo Aleatório Latente \(\Psi(s)\): Captura a estrutura espacial residual (agrupamento).

\[ \Lambda(s) = \mu(s) \cdot \Psi(s) \]

Modelo Log-Cox Gaussiano (LGCP)

É uma classe flexível e popular de modelos Cox.

Assume-se que o logaritmo da intensidade segue um Campo Aleatório Gaussiano (GRF).

\[ \ln[\Lambda(s)] = \underbrace{Z(s)\beta^\top}_{\text{Tendência Fixa}} + \underbrace{\Psi(s)}_{\text{Campo Aleatório}} \]

ou equivalentemente:

\[ \Lambda(s) = \exp \{Z(s)\beta^\top + \Psi(s)\} \]

\(\Psi(s)\) é um Campo Gaussiano com média 0 e função de covariância \(\gamma(r)\).

O termo \(\Psi(s)\) absorve a dependência espacial não explicada, permitindo modelar “manchas” de alta e baixa densidade de forma contínua e suave.

Visualização: Poisson vs Cox

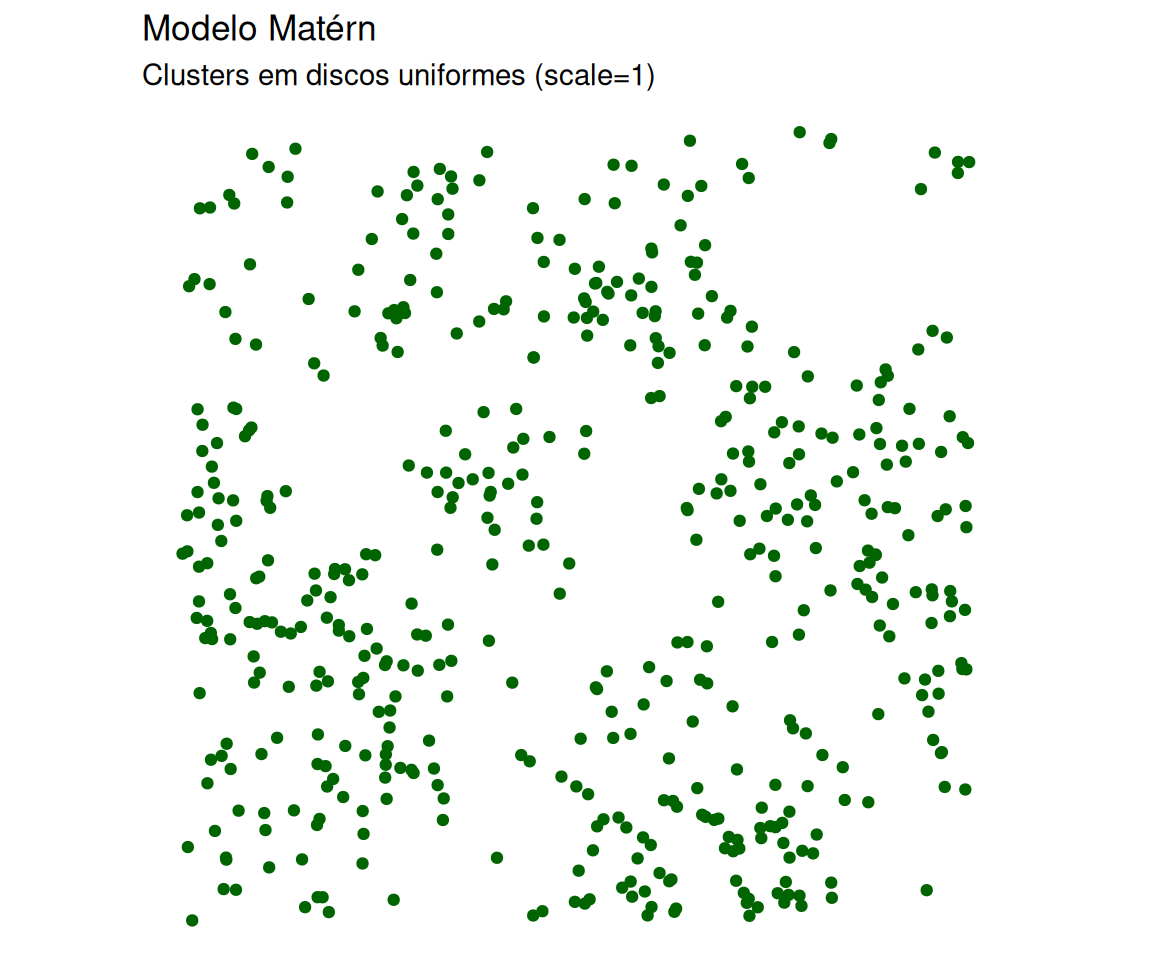

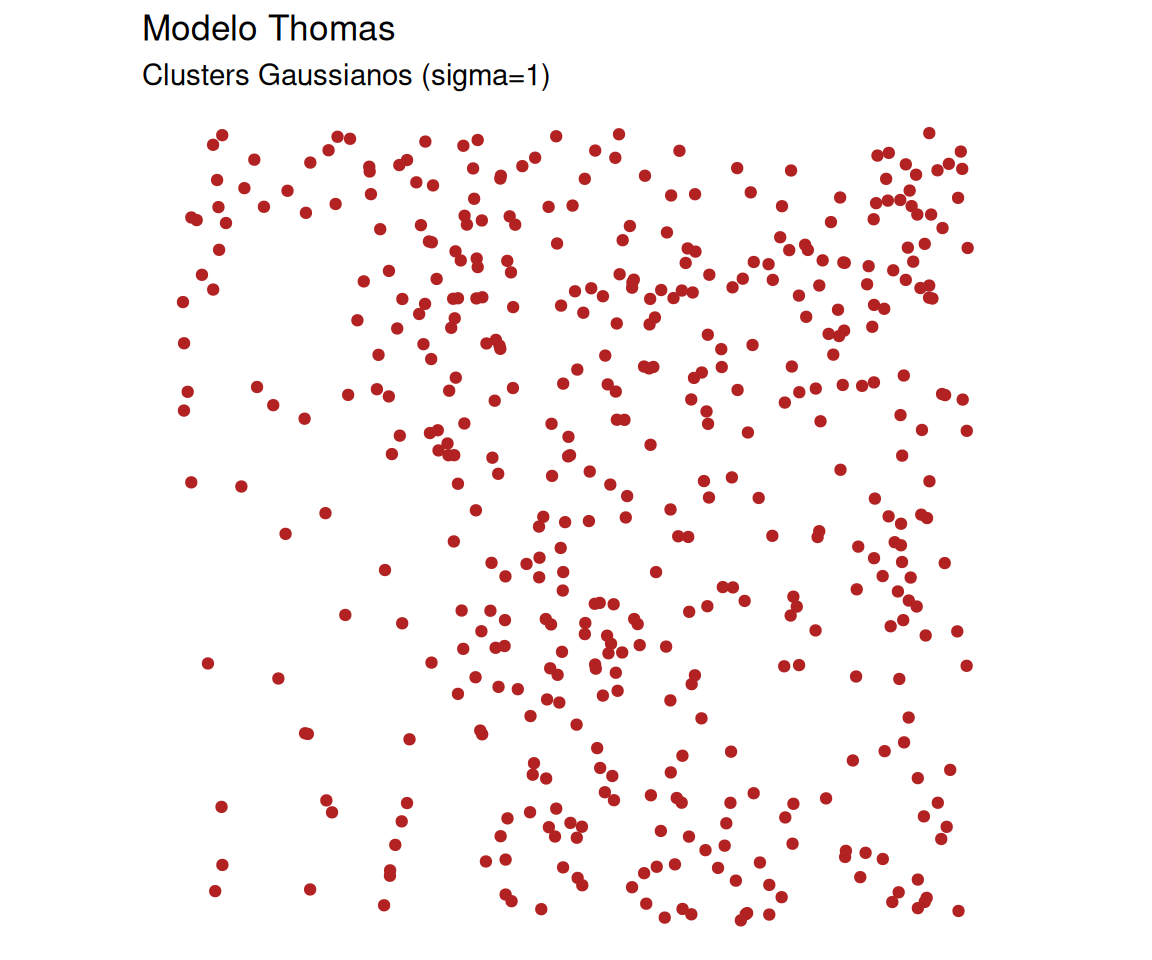

Modelos de Neyman-Scott

Os modelos de Neyman-Scott (1958) descrevem agrupamento através de um processo biológico de “Pais e Filhos” (Moller; Waagepetersen, 2003).

Mecanismo em Duas Etapas:

Processo Pai: Gera-se um processo Poisson homogêneo de eventos “pais” (centros de cluster) com intensidade \(\kappa\).

Processo Filho: Cada pai gera uma “ninhada” de filhos independentemente.

- O número de filhos segue uma distribuição Poisson com média \(\mu\).

- A posição dos filhos segue uma distribuição espacial \(h(\cdot)\) ao redor do pai.

Nota

Apenas os filhos são observados. Os pais são latentes (invisíveis).

Subclasses de Neyman-Scott

A diferença entre os modelos está na dispersão dos filhos (\(h(\cdot)\)).

Distribuição: Uniforme em um disco.

Os filhos são espalhados uniformemente num raio \(r\) ao redor do pai.

\[ h(s) = \frac{1}{\pi r^2} \mathbb{I}(||s|| \leq r) \]

Distribuição: Normal (Gaussiana) Isotrópica.

Os filhos se concentram perto do pai e a densidade decai suavemente com a distância (desvio padrão \(\sigma\)).

\[ h(s) \sim N(0, \sigma^2) \]

Cauchy: Caudas pesadas (filhos podem estar muito longe).

Variância-Gama: Flexibilidade na forma da dispersão.

Modelo Variância-Gama

Segundo Jalilian; Guan; Waagepetersen (2013) e Baddeley; Rubak; Turner (2015), a densidade de probabilidade dos descendentes é dada por:

\[ h(s_{{i}^{'}}) = \frac{1}{2^{\nu+1} \pi \eta^{2} \Gamma(\nu+1)} \frac{||s_{{i}^{'}}||^{\nu}}{\eta^{\nu}} Y_{\nu} \left(\frac{||s_{{i}^{'}}||}{\nu}\right) \]

\(\eta\): Parâmetro de escala.

\(\nu > 1/2\): Parâmetro de forma.

\(Y_{\nu}\): Função Bessel modificada de segunda espécie.

Proporciona maior flexibilidade na modelagem da dispersão dos filhos do que os modelos Gaussianos (Thomas) ou Uniformes (Matérn).

Visualização: Matérn vs Thomas

Modelos de Interação: Gibbs (Markov)

A Necessidade de Interação

Os modelos Poisson e Cox não conseguem modelar explicitamente a repulsão (padrões regulares).

Modelos de Gibbs: Baseados na física estatística, definem a densidade de probabilidade \(f(s)\) baseada nas interações entre eventos vizinhos.

\[ f(s)= \alpha \left[\prod_{i=1}^{n(s)} b(s_{i})\right]\left[\prod_{i<i^{'}} c(s_{i}, s_{i^{'}})\right] \]

\(b(s_i)\): Intensidade de primeira ordem (\(\lambda\)).

\(c(s_i, s_{i'})\): Função de Interação Par-a-Par (Potencial).

Mede a “energia” da configuração.

Se \(c(\cdot) = 1\), recuperamos o Modelo Poisson.

Intensidade Condicional

Na prática, interpretamos Gibbs através da intensidade condicional: qual a probabilidade de um ponto existir em \(s_i\), dada a configuração dos outros pontos \(s_{i'}\)?

\[ \lambda(s_{i}|s_{i^{'}}) = b(s_{i})\left[\prod_{j \neq i} c(s_{i}, s_{j})\right] \]

Dica

Isso permite interpretar o modelo como: “A presença de um ponto vizinho aumenta (atração) ou diminui (inibição) a probabilidade de eu existir aqui?”

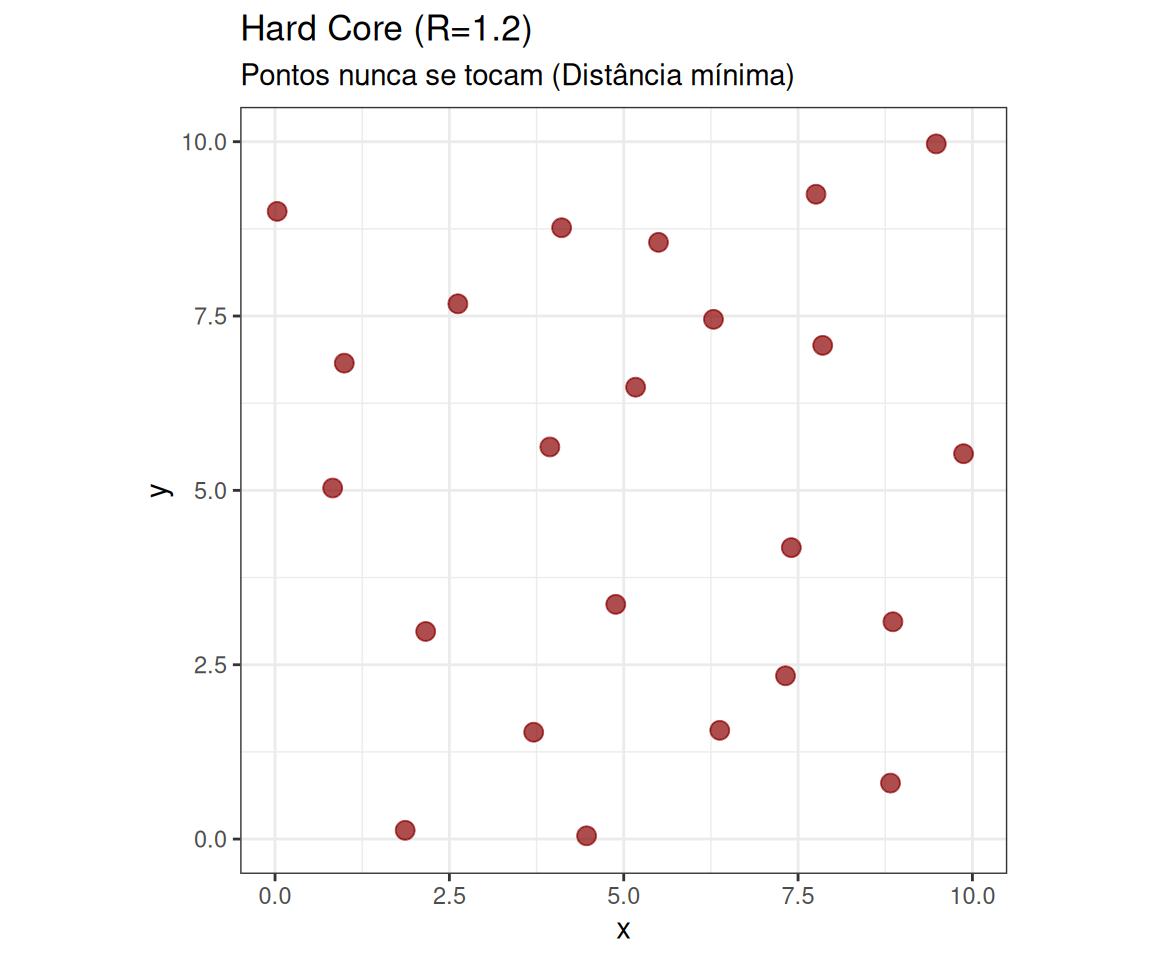

Modelo Hard Core (Núcleo Duro)

O modelo mais estrito de inibição.

É impossível que dois pontos estejam a uma distância menor que \(h\).

Aplicação: Objetos físicos que não podem se sobrepor (árvores, células).

\[ c(s_i, s_j) = \begin{cases} 0 & \text{se } ||s_i - s_j|| < h \quad (\text{Proibido}) \\ 1 & \text{se } ||s_i - s_j|| \geq h \end{cases} \]

A intensidade condicional torna-se zero dentro da distância de exclusão.

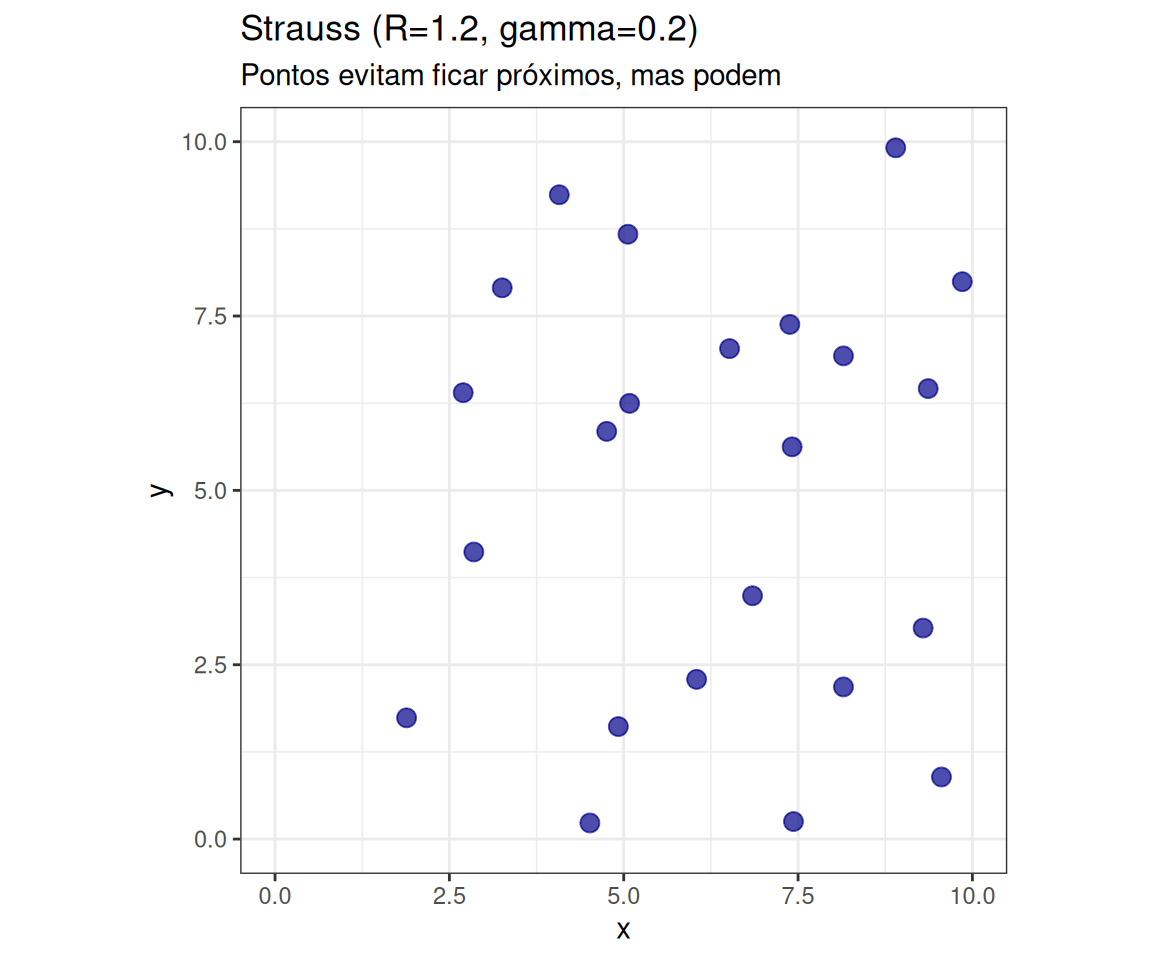

Modelo de Strauss

Uma versão “suave” do Hard Core. Eventos próximos não são proibidos, mas são menos prováveis (penalizados).

\[ c(s_i, s_j) = \begin{cases} \gamma & \text{se } ||s_i - s_j|| \leq d \\ 1 & \text{se } ||s_i - s_j|| > d \end{cases} \]

Parâmetro de interação \(\gamma\):

\(\gamma = 1\): Poisson (Sem interação).

\(0 < \gamma < 1\): Inibição (Strauss Padrão).

\(\gamma = 0\): Hard Core.

\(\gamma > 1\): Agrupamento (Não integrável/Instável para Strauss padrão).

Visualização: Hard Core vs Strauss

Outros Modelos de Par (Soft-Core e Híbridos)

Modelos mais flexíveis para descrever como a interação decai com a distância.

A interação diminui gradualmente, em vez de um degrau abrupto.

\[c(d) = \left(\frac{\sigma}{d}\right)^{2/\kappa}\]

Ideal para modelar competições biológicas contínuas.

Combina uma zona proibida (\(h\)) com uma zona de interação (\(d\)).

\(0\) se \(d \leq h\).

\(\gamma\) se \(h < d \leq R\).

\(1\) se \(d > R\).

Similar ao Strauss Hard Core, mas com uma transição suave (função rampa) entre a inibição total e a independência.

Modelos de Interação por Área

Proposto por Baddeley; Van Lieshout (1995) (Widom-Rowlinson), resolve a limitação do Modelo Strauss para modelar agrupamento.

- A interação não depende da distância par-a-par, mas da área da união de discos de raio \(r\) ao redor dos pontos.

\[f(x) \propto \beta^{n(s)} \gamma^{-A(s, r)}\]

\(A(s, r)\): Área coberta pela união dos discos.

\(\gamma < 1\): Inibição (minimiza a área coberta \(\to\) pontos afastados).

\(\gamma > 1\): Agrupamento (maximiza a sobreposição \(\to\) clusters).

Diagnóstico e Validação de Modelos

Métodos de Diagnóstico

Como saber se o modelo ajustado é adequado?

Existem quatro abordagens estatísticas principais:

Teste da Razão de Verossimilhança (LRT): Comparar modelos aninhados (ex: com vs sem covariáveis).

Teste Escore (Lagrange): Avalia a derivada da log-verossimilhança.

Teste \(\chi^2\) (Qui-Quadrado): Baseado na contagem em quadrats.

Simulações de Monte Carlo: Comparação visual e envelopes.

Teste da Razão de Verossimilhança (LRT)

Útil para testar a significância de covariáveis (\(Z\)) no modelo.

Hipóteses:

\(H_0: \varphi = 0\) (Covariáveis não influenciam).

\(H_a: \varphi \neq 0\).

Estatística:

\[ \Gamma = 2 \log \frac{L_{1}}{L_{0}} = 2 \left( \log L_{1} - \log L_{0} \right) \sim \chi^2_{df} \]

\(L_1\): Verossimilhança do modelo completo.

\(L_0\): Verossimilhança do modelo restrito.

Teste de Ajuste \(\chi^2\)

Avalia a discrepância entre o número observado (\(n_j\)) e o esperado (\(\hat{\mu}_j\)) de eventos em sub-regiões (quadrats).

\[ \chi^{2}=\sum_{j=1}^{m} \frac{\left(n_{j}-\hat{\mu}_{j}\right)^{2}}{\hat{\mu}_{j}} \]

\(\hat{\mu}_{j} = \int_{B_{j}} \hat{\lambda} (s) ds\): Intensidade acumulada na célula \(j\).

Graus de liberdade: \(m - p\) (\(m\) células, \(p\) parâmetros).

Nota

Este teste é sensível à escolha do tamanho dos quadrats.

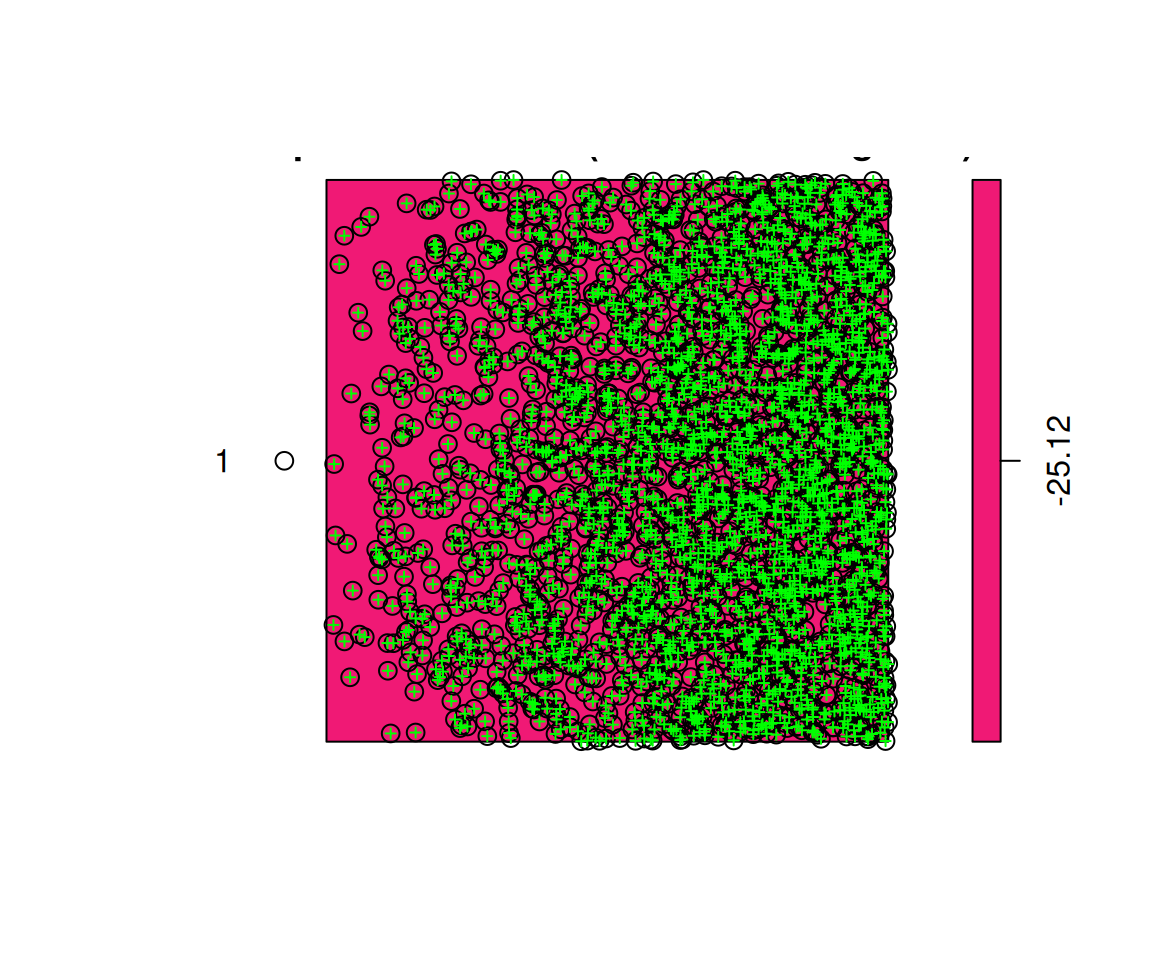

Validação via Resíduos

Para modelos Poisson e Gibbs, a análise de resíduos é fundamental.

- Diferença entre o observado e o esperado em uma região \(B\).

\[ R(B) = n(S\cap B) - \int_{B}\hat{\lambda}(s)ds \]

- Resíduos de Pearson: Padronizados pela variância (Poisson). \[ R_{i}^{P} (B)=\frac{n(S\cap B)-\int_{B}\hat{\lambda}(s)ds}{\sqrt{\int_{B}\hat{\lambda}(s)ds}} \]

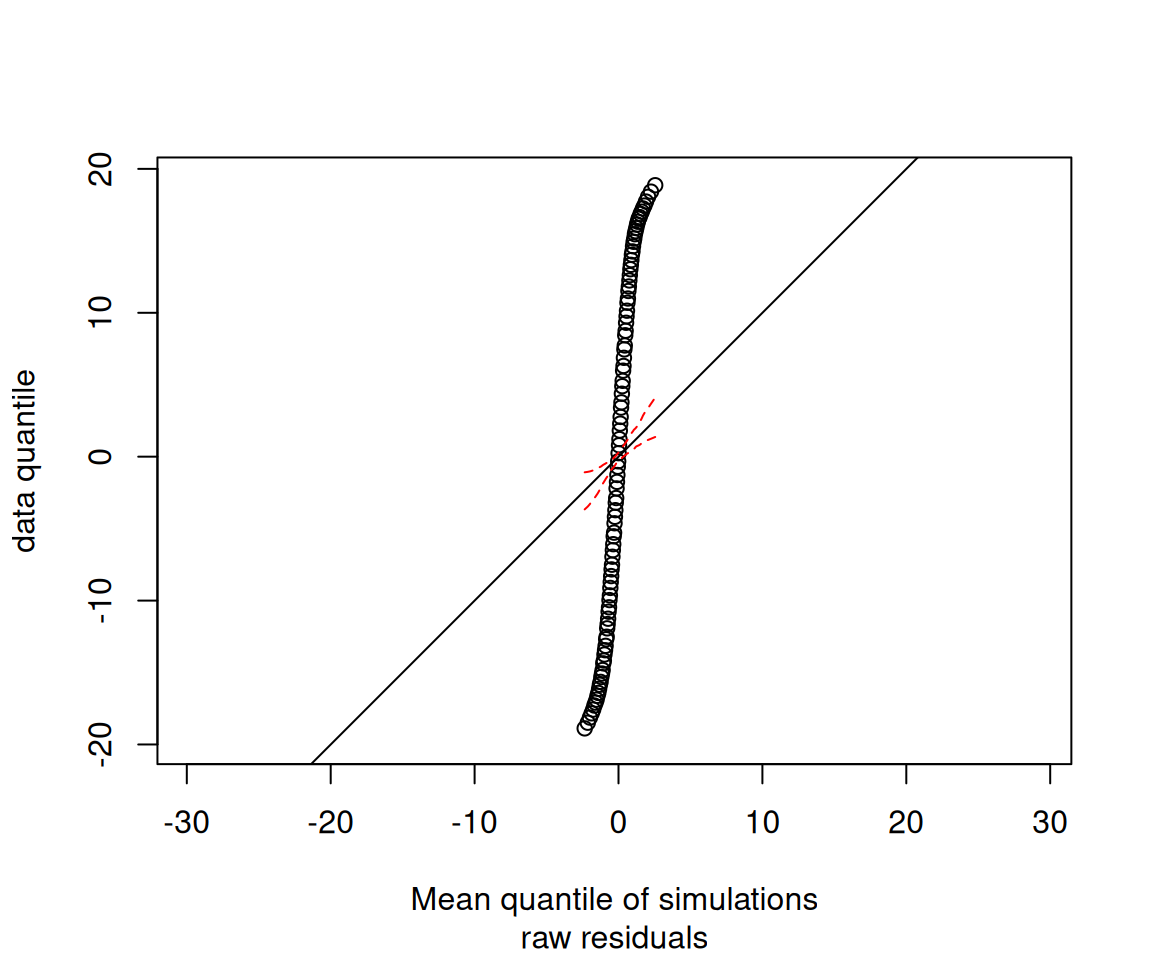

Diagnóstico Visual de Resíduos

Extracting model information...Evaluating trend...done.

Simulating 100 realisations... 1, 2, 3, 4, 5, 6, 7, 8, 9, 10, 11, 12, 13, 14, 15, 16, 17, 18, 19, 20,

21, 22, 23, 24, 25, 26, 27, 28, 29, 30, 31, 32, 33, 34, 35, 36, 37, 38, 39, 40,

41, 42, 43, 44, 45, 46, 47, 48, 49, 50, 51, 52, 53, 54, 55, 56, 57, 58, 59, 60,

61, 62, 63, 64, 65, 66, 67, 68, 69, 70, 71, 72, 73, 74, 75, 76, 77, 78, 79, 80,

81, 82, 83, 84, 85, 86, 87, 88, 89, 90, 91, 92, 93, 94, 95, 96, 97, 98, 99,

100.

Diagnostic info:

simulated patterns contained an average of 2509.92 points.

Calculating quantiles...averaging.....Done.

Dica

Se o modelo for bom, o mapa de resíduos deve parecer “ruído branco” (sem padrão óbvio) e o Q-Q plot deve seguir a reta.

Validação de Modelos Cox

Aviso

- Modelos de Cox (como Log-Cox Gaussiano ou Neyman-Scott) não permitem a análise de resíduos clássica facilmente, pois a intensidade é aleatória.

Alternativas de Validação:

Envelopes de Simulação: Comparar funções \(K(r), L(r), g(r)\) do modelo ajustado com os dados.

Método dos Momentos: Verificar se a variância e média empíricas batem com as teóricas.

Seleção de Modelos (AIC)

Para comparar modelos não aninhados, utilizamos o Critério de Informação de Akaike.

\[AIC = -2 \log L(\hat{\theta}) + 2p\]

\(L(\hat{\theta})\): Máxima verossimilhança.

\(p\): Número de parâmetros.

O modelo com o menor AIC é preferível (melhor ajuste com menos complexidade).

Aplicações dos processos pontuais

Onde os Processos Pontuais são Aplicados?

Dinâmica Florestal: Modelagem da competição entre árvores (padrões regulares) e dispersão de sementes (padrões agrupados).

Biologia: Distribuição de ninhos de pássaros ou tocas de animais.

Fitopatologia: Propagação espacial de doenças em plantações.

Identificação de clusters de doenças (ex: casos de Dengue, Câncer próximo a fontes de poluição).

Modelagem da difusão de vírus onde a proximidade aumenta o risco (Modelos Cox).

Identificação de hotspots criminais baseados em ocorrências passadas.

Distribuição de serviços (escolas, hospitais) em relação à densidade populacional.

Sismologia: Localização de epicentros de terremotos e réplicas.

Astronomia: Distribuição de galáxias no universo.

Neurociência: Localização de neurônios em tecidos cerebrais.

Próximos Passos

Na Aula 08, veremos a parte prática deste conteúdo. Por favor, leia todo o Capítulo 5, com foco na aplicação e pacotes.